Техническое руководство: Создайте локальную базу знаний по искусственному интеллекту за 5 минут при нулевых затратах.

Вы, должно быть, сталкивались с случаями, когда всевозможные большие модели общего назначения говорили серьезную ерунду. Из-за плавной и плавной работы ИИ трудно отличить истину от ложности, что делает невозможным защиту. Это состояние называется ИИ-галлюцинацией.

Причина, по которой большие модели, к сожалению, переворачиваются из-за галлюцинаций, во многом связана с «врожденными недостатками». Например, данные обучения из конкретных полей во время обучения относительно отсутствуют или являются предвзятыми. Для предприятий иллюзия ИИ стала серьезным недостатком, препятствующим его внедрению.

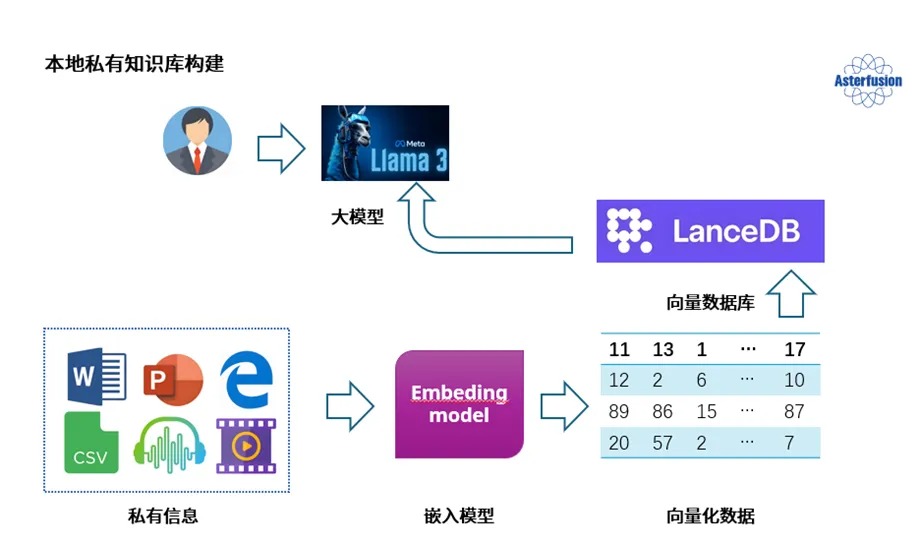

Мы, естественно, хотим, чтобы некоторые частные данные внутри предприятия использовались в процессе вывода и анализа больших моделей, чтобы они могли лучше служить повседневному бизнесу. Однако из соображений информационной безопасности и других соображений частные данные, очевидно, не могут быть загружены на сторонние платформы. воля. В ответ на эту ситуацию существует простое решение — объединить внутреннюю базу знаний предприятия и крупные модели для создания локальной приватизированной и эксклюзивной базы знаний в области ИИ.

Основные шаги по созданию местной частной базы знаний

- Отсортируйте личные данные, требующие анализа модели, такие как текстовые данные (doc, csv, ppt...), аудио- и видеоданные и даже некоторые URL-ссылки.

- Эта информация преобразуется в векторную информацию, которую модель может понять посредством модели внедрения, то есть векторизации информации.

- Сохраните векторизованную информацию в выделенной векторной базе. В данных создайте местную базу знаний.

В настоящее время, когда пользователи задают вопросы, представленная нами общая большая модель будет предоставлять целевые ответы на основе информации, существующей в локальной базе знаний, и даже может специально анализировать информацию в локальной базе знаний для вывода.

Установка и настройка локальной базы знаний ИИ

AnythingLLM — это инструмент для создания локальных баз знаний. Он может напрямую читать документы и обрабатывать большое количество информационных ресурсов, включая загрузку документов, автоматическое сканирование онлайн-документов, автоматическую сегментацию и векторизацию текста, а также улучшенную генерацию локального поиска (RAG). другие функции.

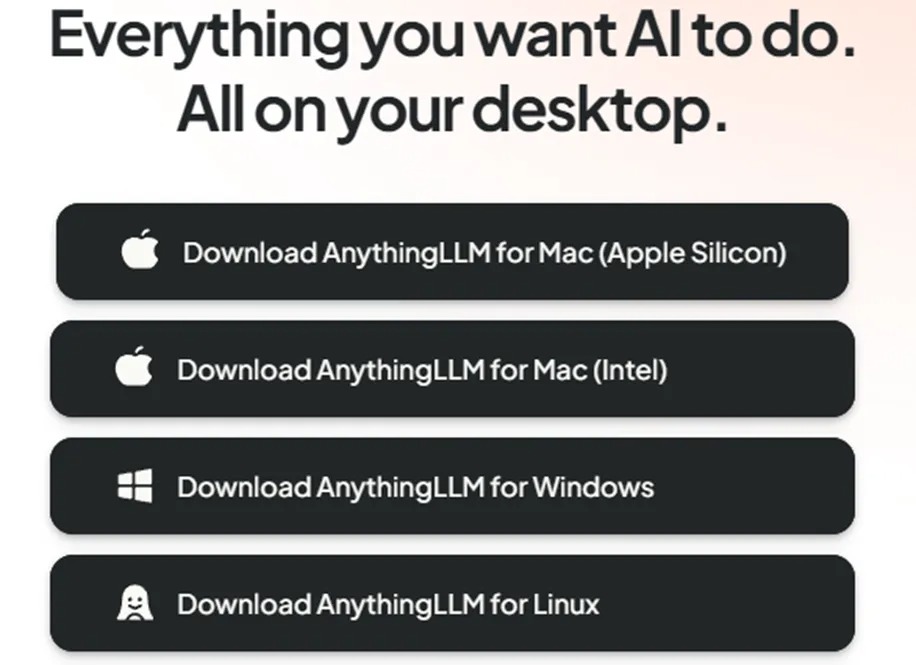

AnythingLLM поддерживает практически все основные большие модели и несколько типов документов. Он легко настраивается и прост в установке. Он подходит для платформ MacOS, Linux и Windows, а также может быть установлен с помощью Docker. AnythingLLM по умолчанию использует LLama2 7B, Mistral 7B, Gemma 2B и другие модели через Ollama, а также может вызывать API-сервисы больших моделей, таких как OpenAI, Gemini, Mistral и так далее. Помимо AnythingLLM, в последнее время популярные инструменты баз знаний включают MaxKB, RAGFlow, FastGPT, Dify, Open WebUI и т. д.

01. Загрузите и установите Ollama (используется для загрузки различных крупных моделей общего назначения)

доступ https://ollama.com/download Выберите нужную версию

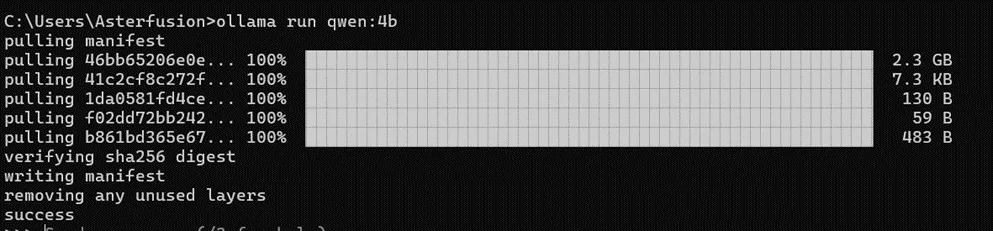

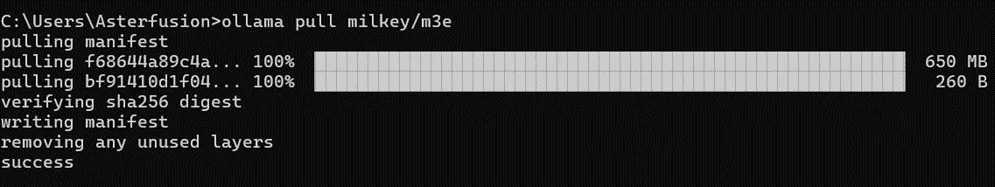

02. Установите большие модели и встроенные модели.

В нашем примере мы выбрали большую модель Tongyi Qianwen и встроенную модель M3e.,Вы также можете выбрать для загрузки другие модели в соответствии с вашими потребностями.。OllamaСписок поддерживаемых моделей и использование ресурсов можно посмотреть на официальном сайте.:https://ollama.com/library

03. Загрузите и установите AnythingLLM.

доступ https://anythingllm.com/download Выберите соответствующую версию

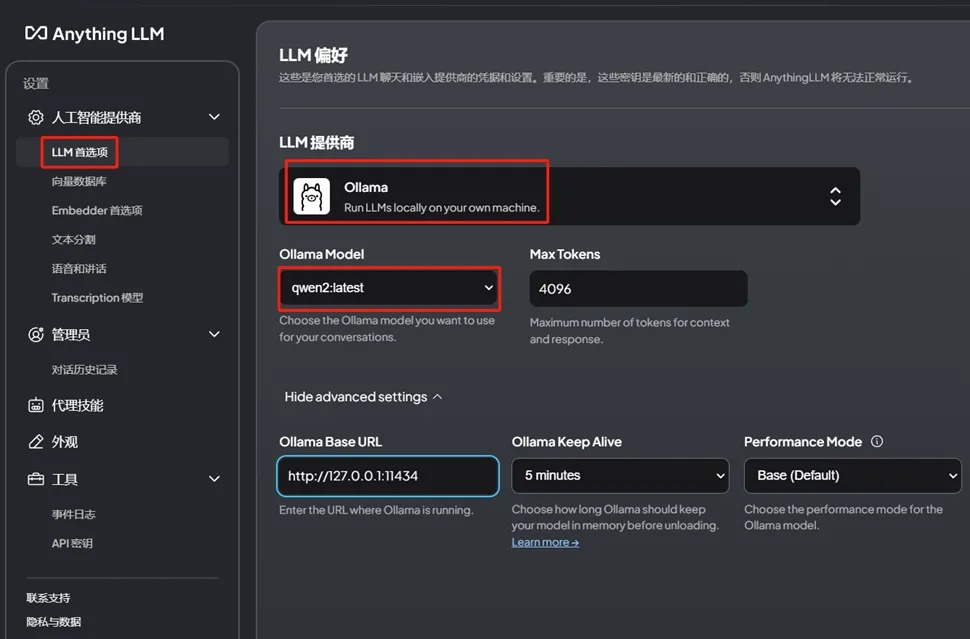

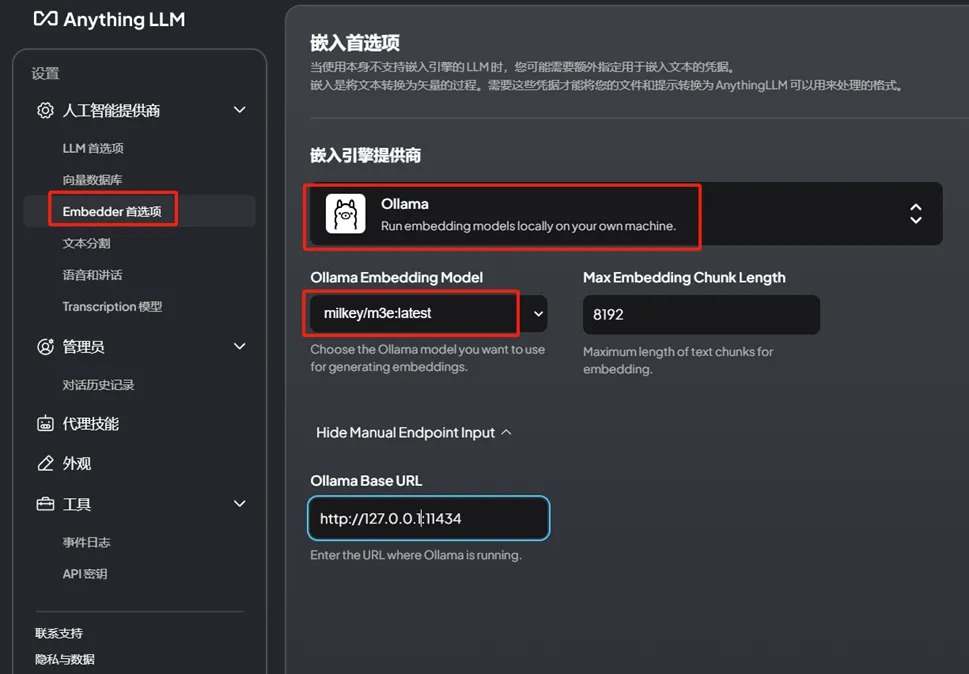

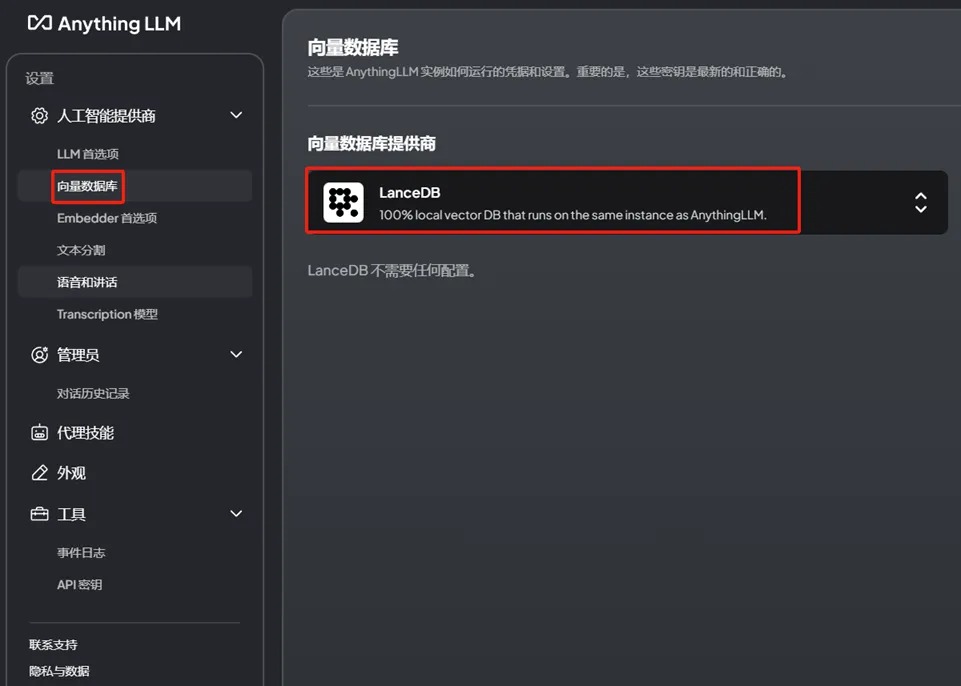

04. Настройте что угодноLLM

Параметры конфигурации выберите Оллама

Встраиватель выбирает M3e

Выберите LanceDB для базы данных векторов (по умолчанию).

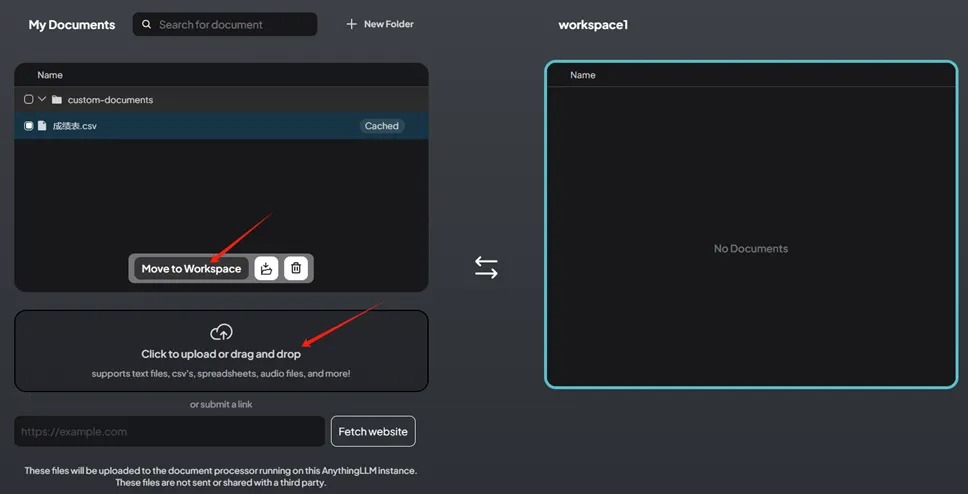

Загрузите личные данные и проверьте эффект вопросов и ответов AI

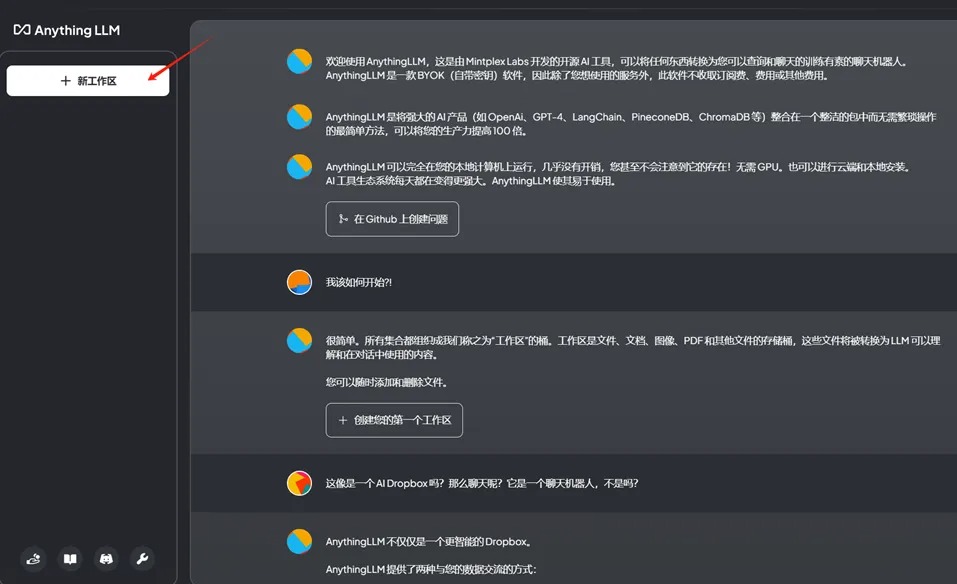

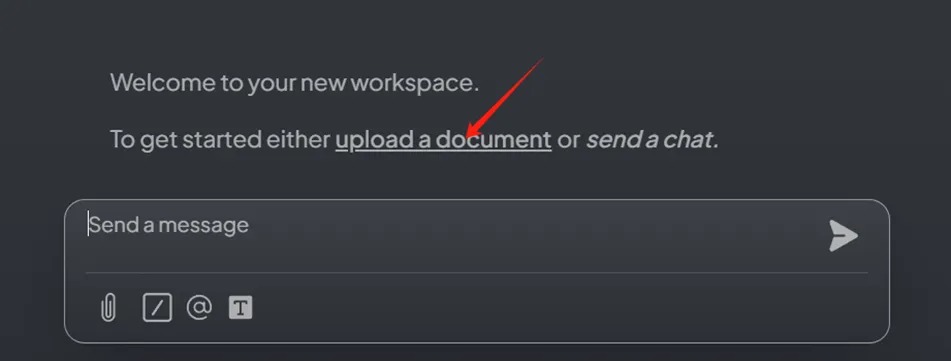

На данный момент создана базовая архитектура локальной частной базы знаний на базе искусственного интеллекта. Далее нам нужно создать рабочее пространство, загрузить корпоративные личные данные в различных форматах документов и проверить, может ли оно работать правильно.

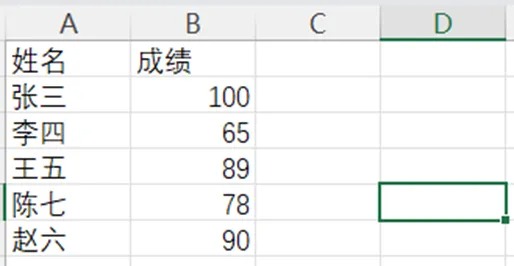

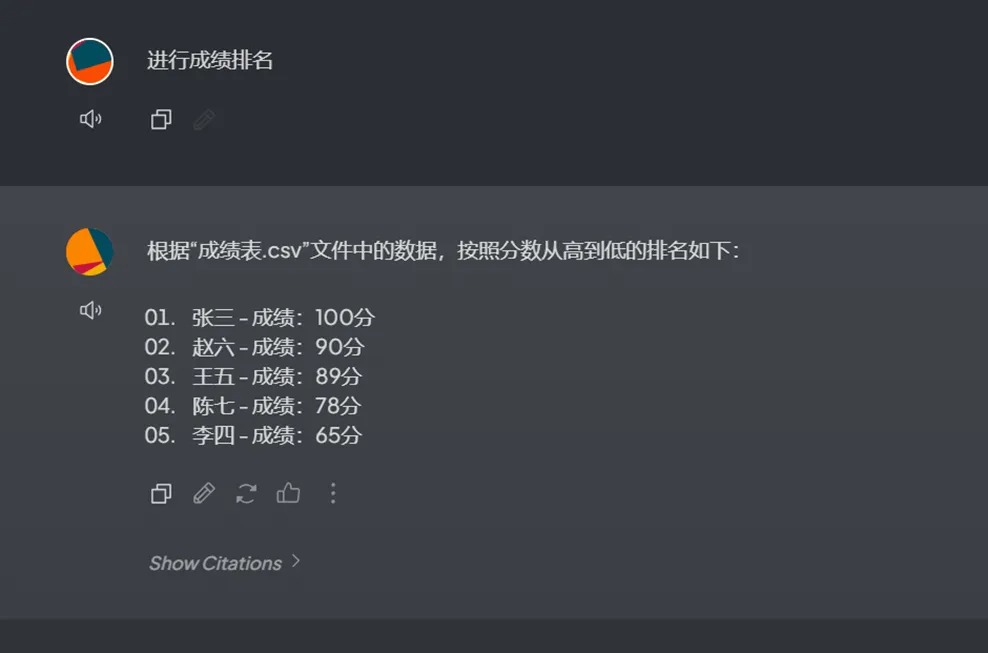

01. таблица csv

Не стесняйтесь генерировать фрагмент необработанных данных следующим образом:

Результаты разговора (сортировка и фильтрация данных):

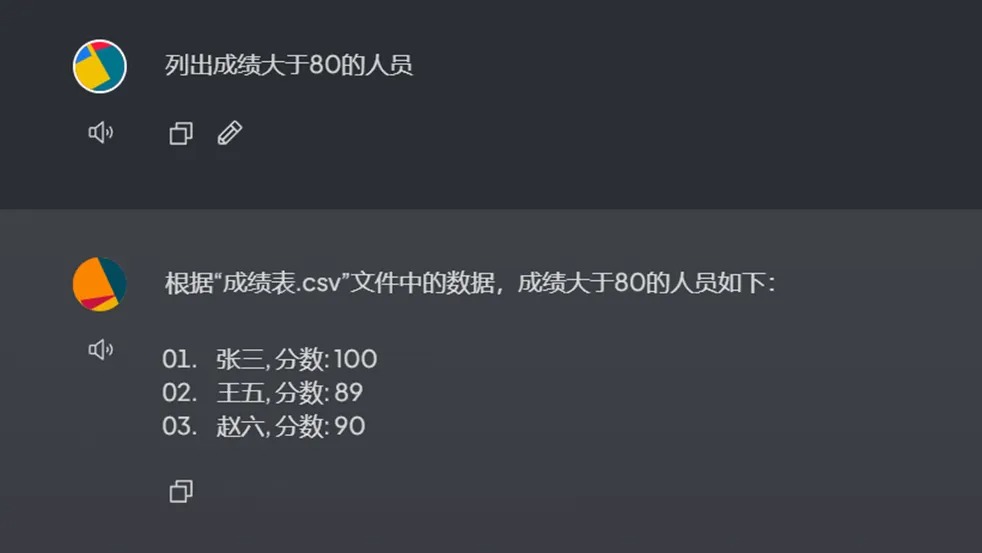

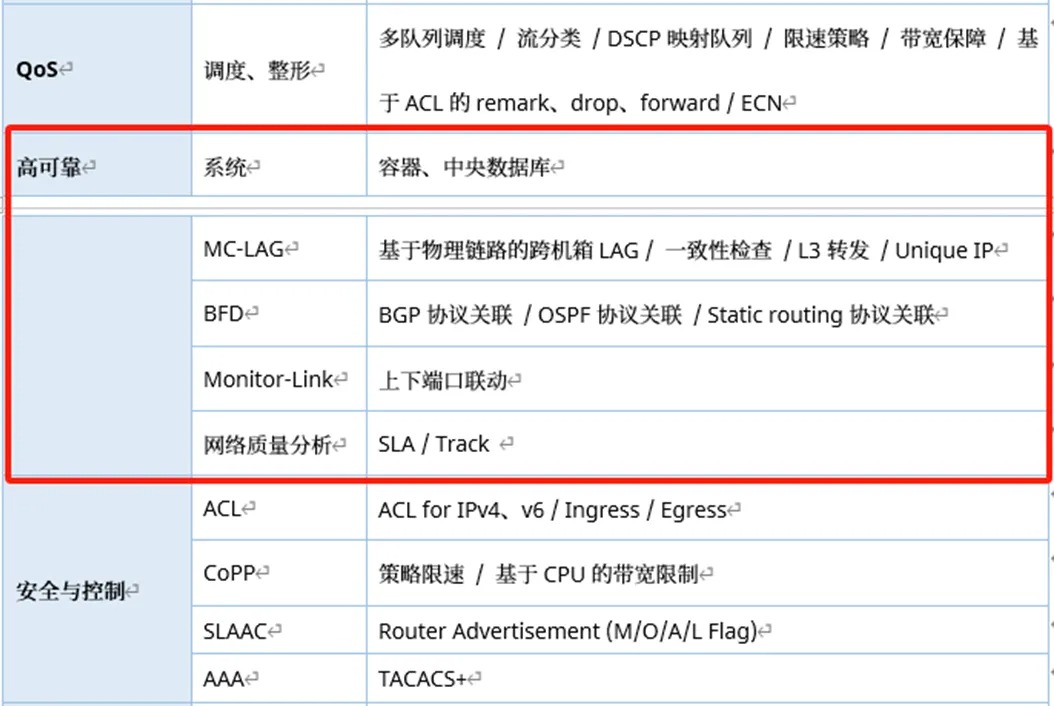

02. docx-документ

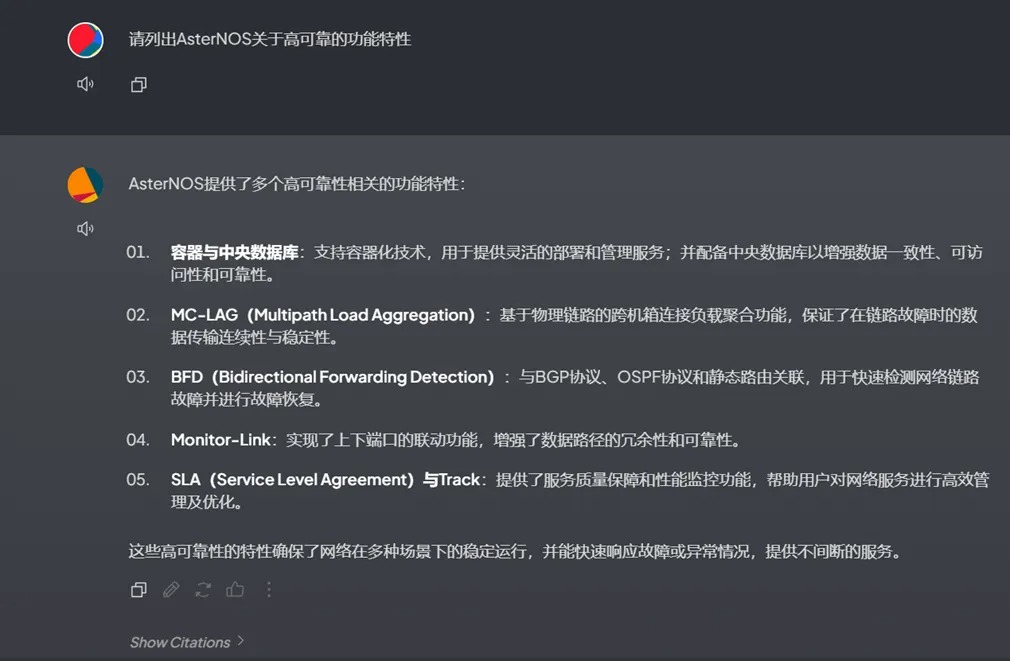

Исходные данные представляют собой документ сетевой операционной системы Xingrongyuan AsterNOS, а детали, включающие функции высокой надежности, следующие.

Результаты разговора:

03. Адрес сайта

Ниже приводится фрагмент функций коммутатора со сверхнизкой задержкой.

Результаты разговора:

Как видите, эта локальная база знаний ИИ уже использует частные текстовые данные, которые мы загрузили для ответов на вопросы. Далее вам необходимо постоянно пополнять частный контент, чтобы сделать его более интеллектуальным и надежным, и крупные предприятия должны его «тщательно настроить». «Например, полностью учтите производительность одновременного доступа локальной системы вывода ИИ, внесите соответствующие корректировки и обновления в сетевую инфраструктуру, а также обратите внимание на интеграцию с другими внутренними инструментами.

Неразрушающее увеличение изображений одним щелчком мыши, чтобы сделать их более четкими артефактами искусственного интеллекта, включая руководства по установке и использованию.

Копикодер: этот инструмент отлично работает с Cursor, Bolt и V0! Предоставьте более качественные подсказки для разработки интерфейса (создание навигационного веб-сайта с использованием искусственного интеллекта).

Новый бесплатный RooCline превосходит Cline v3.1? ! Быстрее, умнее и лучше вилка Cline! (Независимое программирование AI, порог 0)

Разработав более 10 проектов с помощью Cursor, я собрал 10 примеров и 60 подсказок.

Я потратил 72 часа на изучение курсорных агентов, и вот неоспоримые факты, которыми я должен поделиться!

Идеальная интеграция Cursor и DeepSeek API

DeepSeek V3 снижает затраты на обучение больших моделей

Артефакт, увеличивающий количество очков: на основе улучшения характеристик препятствия малым целям Yolov8 (SEAM, MultiSEAM).

DeepSeek V3 раскручивался уже три дня. Сегодня я попробовал самопровозглашенную модель «ChatGPT».

Open Devin — инженер-программист искусственного интеллекта с открытым исходным кодом, который меньше программирует и больше создает.

Эксклюзивное оригинальное улучшение YOLOv8: собственная разработка SPPF | SPPF сочетается с воспринимаемой большой сверткой ядра UniRepLK, а свертка с большим ядром + без расширения улучшает восприимчивое поле

Популярное и подробное объяснение DeepSeek-V3: от его появления до преимуществ и сравнения с GPT-4o.

9 основных словесных инструкций по доработке академических работ с помощью ChatGPT, эффективных и практичных, которые стоит собрать

Вызовите deepseek в vscode для реализации программирования с помощью искусственного интеллекта.

Познакомьтесь с принципами сверточных нейронных сетей (CNN) в одной статье (суперподробно)

50,3 тыс. звезд! Immich: автономное решение для резервного копирования фотографий и видео, которое экономит деньги и избавляет от беспокойства.

Cloud Native|Практика: установка Dashbaord для K8s, графика неплохая

Краткий обзор статьи — использование синтетических данных при обучении больших моделей и оптимизации производительности

MiniPerplx: новая поисковая система искусственного интеллекта с открытым исходным кодом, спонсируемая xAI и Vercel.

Конструкция сервиса Synology Drive сочетает проникновение в интрасеть и синхронизацию папок заметок Obsidian в облаке.

Центр конфигурации————Накос

Начинаем с нуля при разработке в облаке Copilot: начать разработку с минимальным использованием кода стало проще

[Серия Docker] Docker создает мультиплатформенные образы: практика архитектуры Arm64

Обновление новых возможностей coze | Я использовал coze для создания апплета помощника по исправлению домашних заданий по математике

Советы по развертыванию Nginx: практическое создание статических веб-сайтов на облачных серверах

Feiniu fnos использует Docker для развертывания личного блокнота Notepad

Сверточная нейронная сеть VGG реализует классификацию изображений Cifar10 — практический опыт Pytorch

Начало работы с EdgeonePages — новым недорогим решением для хостинга веб-сайтов

[Зона легкого облачного игрового сервера] Управление игровыми архивами