RSAC 2024 Инновационная песочница Reality Defender: платформа обнаружения Deepfake

Профиль компании

1) Профиль компании

Reality Defender — это стартап-компания, основанная в 2021 году и специализирующаяся на обнаружении дипфейков и синтетических носителей. Она предоставляет услуги по обнаружению дипфейков для различных модальностей. Разрабатываемые ею инструменты обнаружения подходят для выявления синтеза искусственного интеллекта и фальшивых текстов, изображений, видео и т. д. и аудио, предоставляя решения для глубокого обнаружения фейков для правительственных учреждений, финансовых предприятий, средств массовой информации и других крупных организаций. На официальном сайте Reality Defender [1] упоминается, что он помог азиатским национальным общественным вещателям и транснациональным банкам справиться с распространением ложной информации и мошенничеством с личными данными, вызванным глубокой подделкой.

В настоящее время Reality Defender получила финансирование в размере 15 миллионов долларов США в рамках серии А, возглавляемой венчурной фирмой DCVC при участии таких организаций, как Comcast, Ex/ante, Parameter Ventures и AI Grant Ната Фридмана.

2) Функции продукта

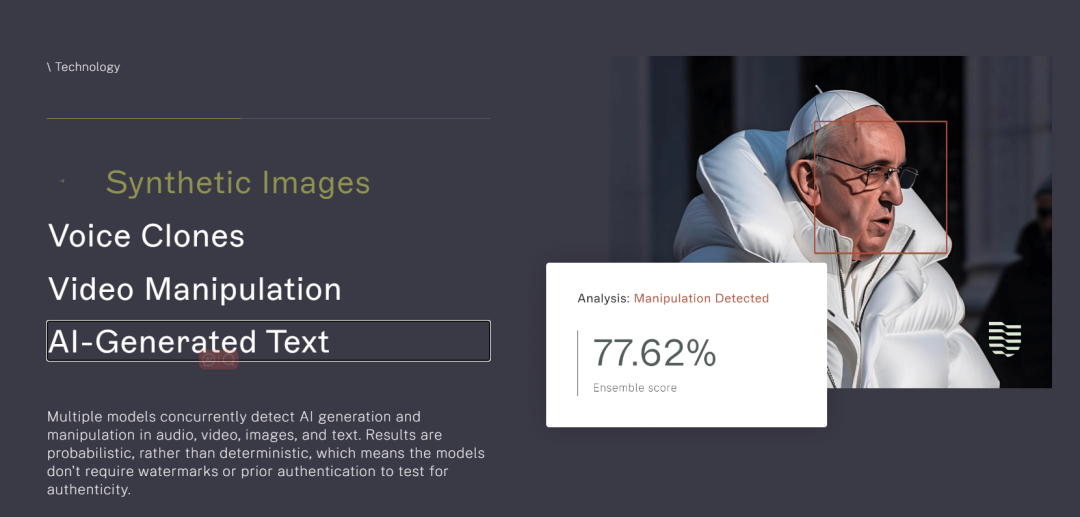

Reality Defender предоставляет множество инструментов обнаружения глубокой подделки, включая инструменты обнаружения текста, изображений, аудио и видео, генерируемых искусственным интеллектом, и может выявлять распространенные угрозы глубокой подделки, такие как подмена лиц, клонирование голоса и мошеннический текст. Эти инструменты предоставляются в виде API-интерфейсов или веб-приложений и используются для анализа и поиска признаков и признаков дипфейковых модификаций в обнаруживаемых образцах, тем самым определяя, являются ли данные в файлах, загружаемых пользователями, синтетическими или поддельными.

Рис. 1. Reality Defender обеспечивает обнаружение изображений, аудио, видео и текста.

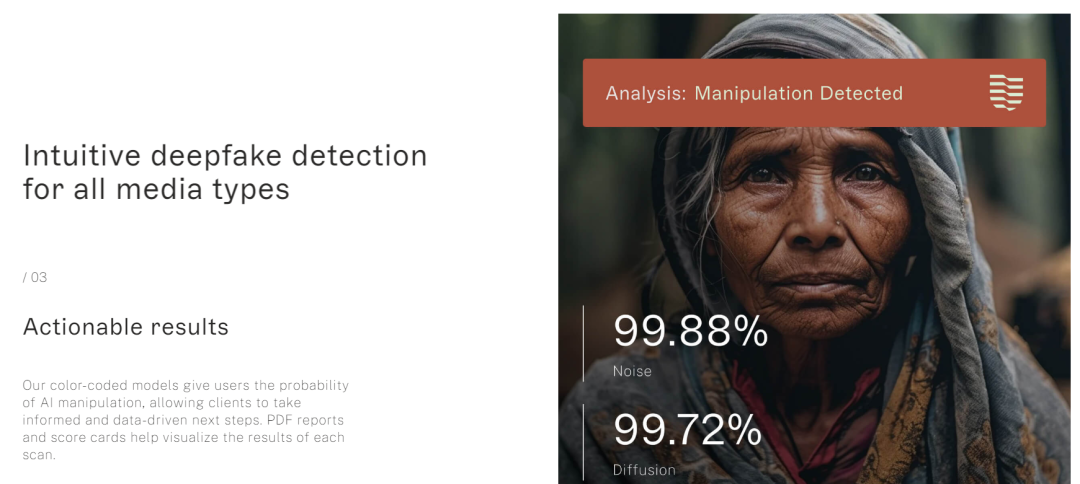

Чтобы создать более надежную и высокоточную систему обнаружения дипфейков, Reality Defender объединяет набор моделей обнаружения искусственного интеллекта вместо одной модели. Он обнаруживает загруженные файлы с разных точек зрения и, наконец, выводит прогнозируемые вероятности и визуализирует результаты.

Рис. 2. Reality Defender обеспечивает уверенность в том, что обнаруживаемое изображение подделано искусственным интеллектом.

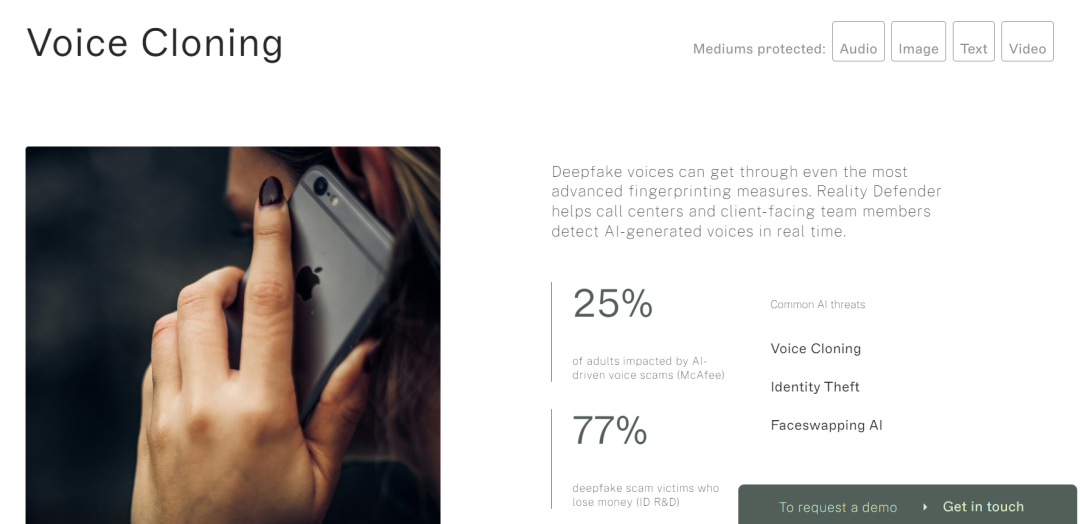

Кроме того, Reality Defender предоставляет инструменты проверки дипфейков в режиме реального времени, позволяющие мгновенно фиксировать потенциальный контент, синтезированный искусственным интеллектом. Эта функция имеет решающее значение для своевременного прекращения финансового мошенничества и предотвращения утечки информации. Пользователи могут встроить инструмент обнаружения Reality Defender в набор инструментов, чтобы гарантировать, что личность другой стороны отслеживается в режиме реального времени во время звонка и разговора, предотвращая падение пользователей. в ловушки для кражи личных данных.

Рис. 3. Reality Defender поддерживает обнаружение подделки аудио в реальном времени.

В целом, инструменты обнаружения дипфейков, предоставляемые Reality Defender, могут выявлять ложный медиаконтент и вредоносную информацию, помогая командам предотвращать и реагировать на угрозы дипфейков искусственного интеллекта.

Технология глубокой подделки и обнаружения

1) Глубокие фейки

В 2017 году пользователь Reddit «deepfakes» выпустил первый алгоритм deepfake, который может проецировать лицо известного актера на порнографическое видео; в 2018 году BuzzFeed использовал программное обеспечение FakeApp для создания дипфейкового видео речи Обамы в 2019 году; Злоумышленник успешно выдал себя за голос генерального директора немецкой компании на основе программного обеспечения искусственного интеллекта и побудил генерального директора британской энергетической компании передать 2 20 000 евро... Поскольку глубокая подделка привлекла внимание, в Интернете продолжают появляться приложения для глубокой подделки (такие как FakeApp, Faceswap и т. д.), позволяющие любому нетехническому человеку легко и без особых затрат создавать различные фейковые видеоролики. Хотя глубокая подделка играет положительную роль в сфере кинопроизводства, она также спровоцировала общественную панику по поводу распространения ложных новостей, выдачи себя за другое лицо, телекоммуникационного мошенничества и других явлений в социальных сетях, что серьезно подрывает социальное доверие и информационный порядок.

Deepfake — это тип атаки, в которой используются алгоритмы глубокого обучения для захвата выражений лица, движений и характеристик голоса людей, а также обучения тому, как заменять лица на изображениях или видео и как синтезировать ложные и реалистичные голоса. Дипфейки зачастую трудно обнаружить невооруженным глазом.

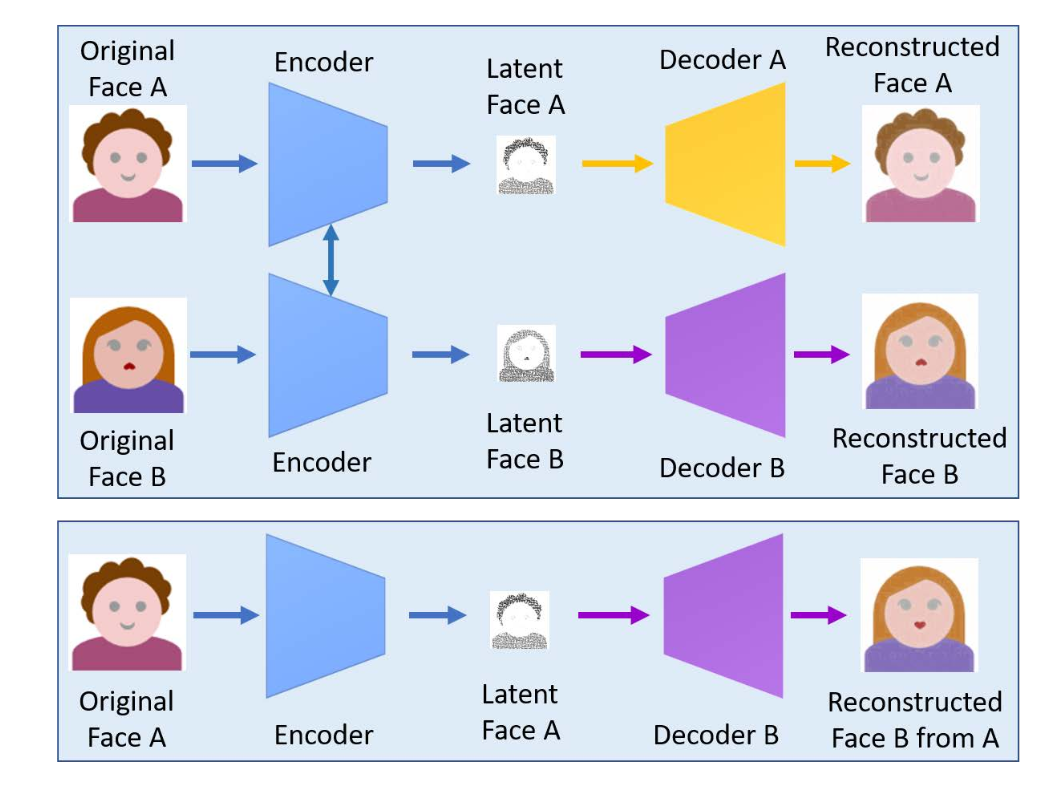

В задаче визуальной подделки изображений и видео технология глубокой подделки требует подделки лиц. Существует два основных метода: один — подмена лица, предполагающая замену лица или синтез нового лица, без модификации лица. модифицируя знак лица, измените некоторые атрибуты исходного лица, например, подделку выражений и подделку определенных действий. Технология визуальной глубокой подделки обычно использует сверточную нейронную сеть (CNN) и генеративно-состязательные сети (GAN) в качестве базовой архитектуры для передачи стилей и сшивания лиц, а также сочетает в себе некоторые технологии глубокого обучения для повышения подлинности и стабильности генерируемого контента. Например, в Faceswap-GAN [2] введены фильтр Калмана и высокие потери при реконструкции, чтобы устранить джиттер, вызванный заменой лица, и улучшить качество генерации области глаз.

Рисунок 4. Принципиальная схема технологии визуальной глубокой подделки[3]

В задаче глубокой подделки звука технология глубокой подделки может выполнять синтез текста в речь (TTS) и преобразование голоса (синтез голоса в речь генерирует голосовой вывод для указанного текста, а преобразование голоса остается неизменным). исходного тембра до целевого тембра достигается, в то время как речевое содержимое остается неизменным. Технология глубокой подделки аудио обычно включает в себя модели искусственного интеллекта, такие как скрытые модели Маркова, модели гауссовской смеси, автокодеры, авторегрессионные модели и генеративно-состязательные сети, в сочетании с такими методами, как спектральное преобразование и расширенная свертка, для обеспечения высокой точности аудиосэмплов.

Генеративные большие модели, добившиеся в последние годы технологических прорывов, также стали катализатором глубокой подделки. Генеративные большие модели могут более точно имитировать выражение лица, движения тела и тембр человека, что делает контент дипфейков более реалистичным и трудно различимым. к появлению глубокого фейкового контента. Его распространение более широко распространено и его трудно контролировать.

2) Глубокое обнаружение фейков

Наиболее распространенной технологией обнаружения дипфейков изображений и видео является метод обнаружения, основанный на различиях в характеристиках изображений до и после подделки или на особенностях изображений, сгенерированных GAN. Первый обычно имеет лучшее обобщение и использует модели глубокого обучения для извлечения изменяющихся функций, таких как обнаружение артефактов в изображениях/отдельных видеокадрах или обнаружение временных особенностей между видеокадрами. Последний более целенаправленный, GAN очень популярен для методов глубокой подделки. Модель, поскольку ее метод обработки цвета, статистические характеристики пространства цветности и т. д. при синтезе образцов будут отличаться от реальных изображений, снятых камерой, и даже оставят стабильные отпечатки модели в сгенерированных изображениях, поэтому функции изображения, созданные GAN Conducting Инспекции также образуют самостоятельное направление.

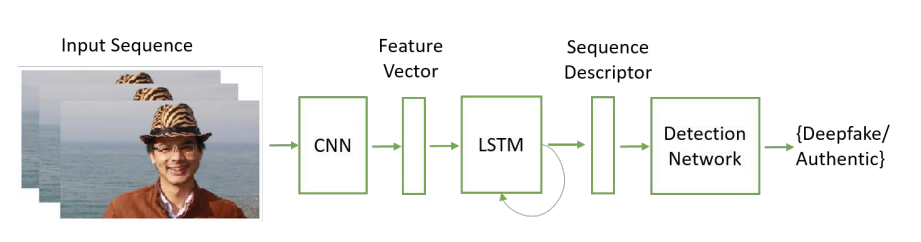

Рисунок 5. Пример решения для обнаружения видео: извлечение временных характеристик на основе CNN и LSTM [4]

Для одномерных поддельных звуковых сигналов существующие решения по обнаружению в основном полагаются на дифференцированные характеристики биологической информации (такие как скорость речи, голосовой отпечаток, спектральное распределение и т. д.) для обнаружения специальной шумовой информации и следов подделки в поддельной речи. В то же время сложно полностью выявить признаки подделки с помощью одной функции. Поэтому некоторые решения SOTA объединяют информацию о нескольких дополнительных функциях для повышения надежности алгоритма обнаружения.

Несмотря на то, что текущие исследования в области технологии обнаружения дипфейков достигли прогресса, с быстрым развитием технологии дипфейков существующие решения все еще имеют некоторые проблемы, которые необходимо решить:

- Улучшите способность к обобщению и надежность алгоритмов обнаружения. Существующим методам обнаружения не хватает изучения общих особенностей нескольких типов подделок, и они слишком полагаются на распределение и характеристики обучающих данных. Их возможности обнаружения значительно снижаются при столкновении с типами подделок, отличными от обучающего набора и неизвестными поддельными данными. А когда метод обнаружения используется в сложных реальных сценах, это повлияет на точность обнаружения. Следовательно, улучшая разнообразие обучающих данных для обнаружения алгоритма, мы должны также улучшить способность обнаружения алгоритма по нескольким функциям. на и добыча,Комплексный учет изменений освещения, особенностей текстуры лица, изменений контура лица, положения черт лица, а также многоракурсных функций, таких как отпечаток голоса, фонемы и скорость речи.,Улучшите способность к обобщению и надежность алгоритма обнаружения.

- Содействие исследованиям алгоритмов мультимодального обнаружения. Большинство существующих решений по тестированию ориентированы только к одномодальному обнаружению подделки относится единственный тип образца подделки (картинаизображение или речь). Однако для достижения более реалистичных эффектов реальная технология глубокой подделки может одновременно подделывать как видео, так и аудио. Поэтому стало актуальным изучить технологию мультимодального обнаружения поддельных данных, которую также можно использовать, как Reality. Defender также повышает точность обнаружения сложных технологий глубокой подделки за счет интеграции нескольких методов обнаружения.

Подвести итог

Появление генеративных моделей, таких как ChatGPT и Sora, стало новым оружием технологии глубокой подделки. Быстрый прогресс технологии глубокой подделки увеличил сложность обнаружения. Помимо Reality Defender, многие технологические гиганты и стартапы инвестируют в исследования и разработку инструментов в области обнаружения дипфейков с помощью искусственного интеллекта. Например, работают Intel FakeCatcher, стартап по обнаружению дипфейков Optic и Blackbird.ai, созданный в 2014 году. по выявлению искусственного интеллекта. Ожидается, что в будущем продукты для глубокого обнаружения подделок будут уделять больше внимания потребностям обнаружения в реальном времени и мультимодального обнаружения, повышая надежность и точность обнаружения. также будет внедрена технология глубокой подделки, чтобы справиться с более зрелыми и сложными технологиями глубокой подделки обеспечивает хорошую рыночную среду для разработки продуктов для обнаружения глубокой подделки.

Ссылки

[1] http://www.realitydefender.com

[2] Faceswap-GAN. https : / / github . com / shaoanlu /faceswap-GAN.

[3] Nguyen T T, Nguyen Q V H, Nguyen D T, et al. Deep learning for deepfakes creation and detection: A survey[J]. Computer Vision and Image Understanding, 2022, 223: 103525.

[4] David G¨uera and Edward J Delp. Deepfake video detection using recurrent neural networks. In 15th IEEE International Conference on Advanced Video and Signal based Surveillance (AVSS), pages 1–6. IEEE, 2018.

Неразрушающее увеличение изображений одним щелчком мыши, чтобы сделать их более четкими артефактами искусственного интеллекта, включая руководства по установке и использованию.

Копикодер: этот инструмент отлично работает с Cursor, Bolt и V0! Предоставьте более качественные подсказки для разработки интерфейса (создание навигационного веб-сайта с использованием искусственного интеллекта).

Новый бесплатный RooCline превосходит Cline v3.1? ! Быстрее, умнее и лучше вилка Cline! (Независимое программирование AI, порог 0)

Разработав более 10 проектов с помощью Cursor, я собрал 10 примеров и 60 подсказок.

Я потратил 72 часа на изучение курсорных агентов, и вот неоспоримые факты, которыми я должен поделиться!

Идеальная интеграция Cursor и DeepSeek API

DeepSeek V3 снижает затраты на обучение больших моделей

Артефакт, увеличивающий количество очков: на основе улучшения характеристик препятствия малым целям Yolov8 (SEAM, MultiSEAM).

DeepSeek V3 раскручивался уже три дня. Сегодня я попробовал самопровозглашенную модель «ChatGPT».

Open Devin — инженер-программист искусственного интеллекта с открытым исходным кодом, который меньше программирует и больше создает.

Эксклюзивное оригинальное улучшение YOLOv8: собственная разработка SPPF | SPPF сочетается с воспринимаемой большой сверткой ядра UniRepLK, а свертка с большим ядром + без расширения улучшает восприимчивое поле

Популярное и подробное объяснение DeepSeek-V3: от его появления до преимуществ и сравнения с GPT-4o.

9 основных словесных инструкций по доработке академических работ с помощью ChatGPT, эффективных и практичных, которые стоит собрать

Вызовите deepseek в vscode для реализации программирования с помощью искусственного интеллекта.

Познакомьтесь с принципами сверточных нейронных сетей (CNN) в одной статье (суперподробно)

50,3 тыс. звезд! Immich: автономное решение для резервного копирования фотографий и видео, которое экономит деньги и избавляет от беспокойства.

Cloud Native|Практика: установка Dashbaord для K8s, графика неплохая

Краткий обзор статьи — использование синтетических данных при обучении больших моделей и оптимизации производительности

MiniPerplx: новая поисковая система искусственного интеллекта с открытым исходным кодом, спонсируемая xAI и Vercel.

Конструкция сервиса Synology Drive сочетает проникновение в интрасеть и синхронизацию папок заметок Obsidian в облаке.

Центр конфигурации————Накос

Начинаем с нуля при разработке в облаке Copilot: начать разработку с минимальным использованием кода стало проще

[Серия Docker] Docker создает мультиплатформенные образы: практика архитектуры Arm64

Обновление новых возможностей coze | Я использовал coze для создания апплета помощника по исправлению домашних заданий по математике

Советы по развертыванию Nginx: практическое создание статических веб-сайтов на облачных серверах

Feiniu fnos использует Docker для развертывания личного блокнота Notepad

Сверточная нейронная сеть VGG реализует классификацию изображений Cifar10 — практический опыт Pytorch

Начало работы с EdgeonePages — новым недорогим решением для хостинга веб-сайтов

[Зона легкого облачного игрового сервера] Управление игровыми архивами