OFC2024: О LPO и LRO

В ходе эволюции технологий центров обработки данных в последние годы серверные сети AI/ML расширялись быстрее, чем мы ожидали. Конференция OFC в этом году, несомненно, является лучшим объяснением этого явления: масштабы беспрецедентны.

По нашему мнению, раньше этой областью руководила Google, но теперь ею управляет Nvidia. Благодаря своему доминирующему положению в сфере ИИ-вычислений она играет важную роль в содействии развитию оптических технологий, таких как оптическая связь.

Прогнозируется, что к 2025 году оптический спрос на серверные сети AI/ML будет на одном уровне с существующим крупным рынком интерфейсных сетей, и вполне вероятно, что через два года серверная часть превзойдет интерфейсную часть. . Конечно, вместе с этим возникает потребность в интерфейсах с более высокой скоростью и плотностью передачи данных.

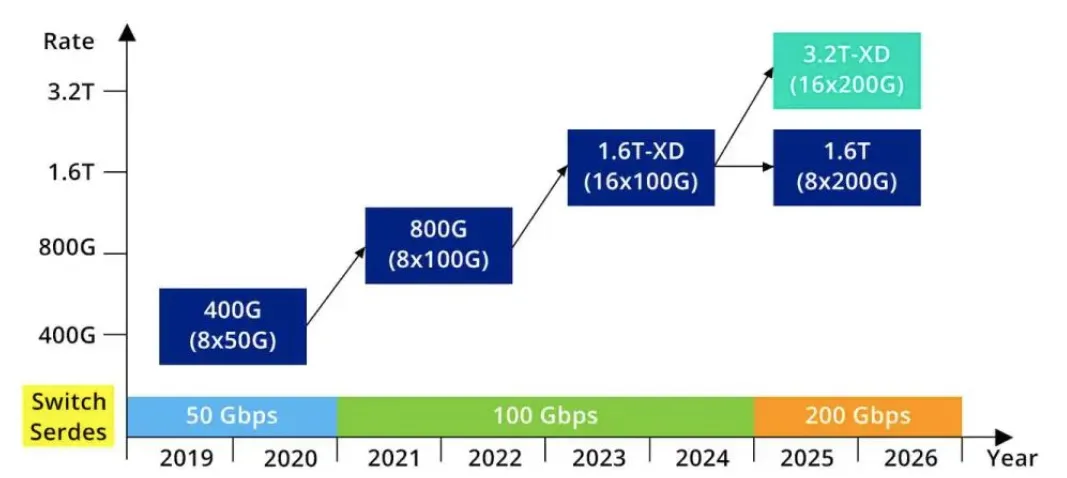

В результате мы видим значительный интерес к подключаемым оптическим трансиверам емкостью 800 ГБ, 1,6 ТБ и будущим 3,2 ТБ для внешних и внутренних структур центров обработки данных.

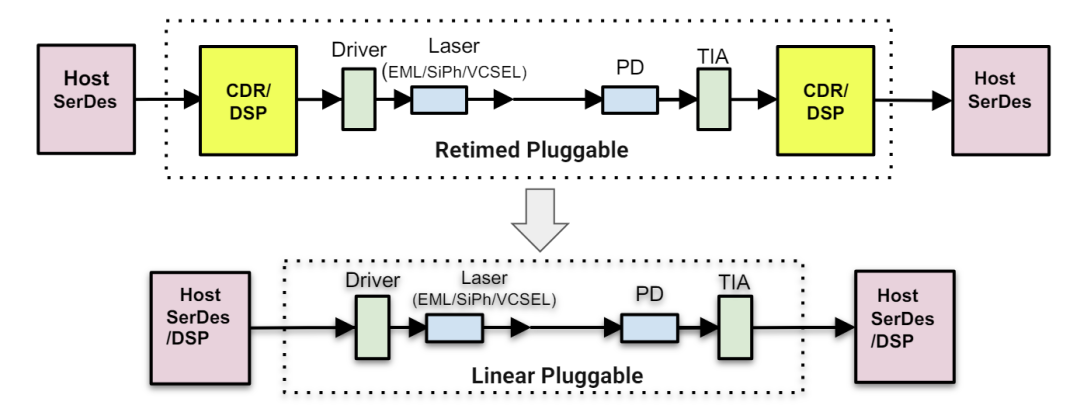

В прошлом году концепция линейной подключаемой оптики (LPO) вызвала бурную дискуссию. Она теоретически может значительно снизить энергопотребление и стоимость за счет перемещения DSP с оптических модулей на хост-ASIC. Такие компании, как Cisco, доказали преимущества этой инновации с помощью данных. Однако со временем люди начали обращать внимание на стабильность ссылок, диагностику производительности и т. д., что привело к охлаждению энтузиазма по поводу продвижения LPO.

В этом контексте линейная приемная оптика (ЛРО) рассматривается как компромиссное решение. То есть, используя ретаймер на стороне передатчика (Tx), линейный приемник подключается непосредственно к ASIC хоста. Хотя это решение не такое энергопотребление и экономичность, как LPO, оно все же снижает энергопотребление модуля и определенную стоимость по сравнению с модулем с полной пересинхронизацией, а также обеспечивает некоторую диагностическую поддержку канала.

При скорости 100 Гбит на канал LRO и LPO имеют большие преимущества в снижении энергопотребления и стоимости. Однако относительно осуществимости LPO в сценарии с одноволновой скоростью 200 Гбит/с на конференции OFC в этом году была проведена горячая дискуссия. для этой цели. Судя по докладам экспертов на встрече, в настоящее время существует два основных лагеря:

- Arista и Macom решительно поддерживают технологию LPO и считают, что она по-прежнему возможна даже на скорости 200 Гбит/с.

- У Google, Meta, Huawei и Alibaba разные мнения. Они считают, что для достижения скорости передачи одной волны 200 Гбит/с необходимо ввести таймер повторной передачи и принять традиционное решение DSP. Обеспечьте высокую производительность канала и большой бюджет канала с помощью DSP для эффективной борьбы с потерями и помехами в канале и многое другое...

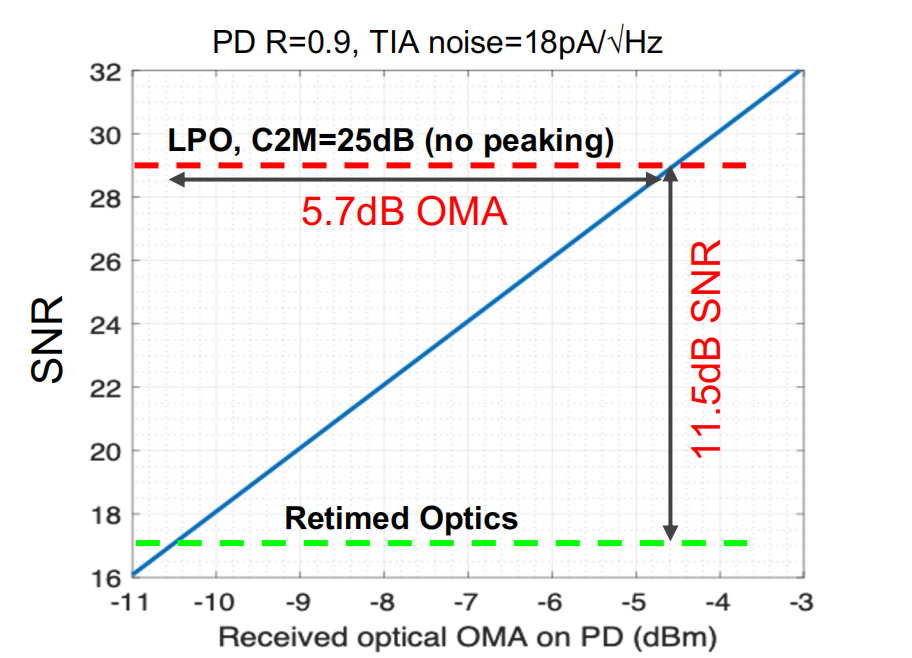

Рисунок: LPO без ретаймера, 25 д Б (C2M), требует отношения сигнал/шум на 11,5 д Б выше, чем у оптики с ретаймером.

Кроме того, на рынке до сих пор остаются большие сомнения по поводу энергопотребления ПОЛ. Хотя решение LPO исключает энергопотребление сериализатора/десериализатора (SerDes) и oDSP в модуле, из-за более строгих требований к потерям канала сигнал необходимо компенсировать на стороне хоста, что приводит к SerDes на стороне хоста. . энергопотребление увеличивается.

Мы видим, что, хотя первоначальной целью решения LPO было снижение энергопотребления, вопрос о том, как продолжать эффективно снижать энергопотребление при одновременном увеличении скорости канала, по-прежнему остается проблемой, с которой сталкивается отрасль. Этот спрос также привел к появлению инновационных технологий охлаждения, таких как жидкостное охлаждение и иммерсионное охлаждение, которые рассеивают тепло посредством прямого или косвенного контакта с жидкостью и могут эффективно облегчить проблемы управления температурным режимом, вызванные высокоскоростным оборудованием и высокой плотностью размещения. В настоящее время понятно, что каждая компания ищет индивидуальные решения в соответствии со своей ситуацией.

Здесь я хотел бы упомянуть PPT LPO и 400G DR4, показанный Се Чуном из Alibaba на семинаре. Согласно содержанию PPT, LPO снижает энергопотребление на 50%, задержку на 100% и производственные затраты на 30%. Однако, как отметили Чхонджин Се и многие другие эксперты на конференции, возможность реализации однополосной технологии LPO со скоростью 200 Гбит/с остается серьезной нерешенной проблемой отрасли.

Хотя на прошлогодней конференции OFC мы увидели дебют первых оптических модулей с поддержкой одноканальной технологии 200 Гбит/с. Эти первоначальные решения совместимы с электрическими каналами хост-интерфейса со скоростью 100 Гбит/с благодаря конструкции, напоминающей «коробку передач». Хотя некоторые передовые разработчики могут выбрать системы и оптические модули с такой конфигурацией, в долгосрочной перспективе более идеальным решением будет напрямую использовать электрические каналы 200 Гбит/с для соединения хоста и оптических модулей, что позволит лучше использовать одиночный канал 200 Гбит/с. оптических модулей.

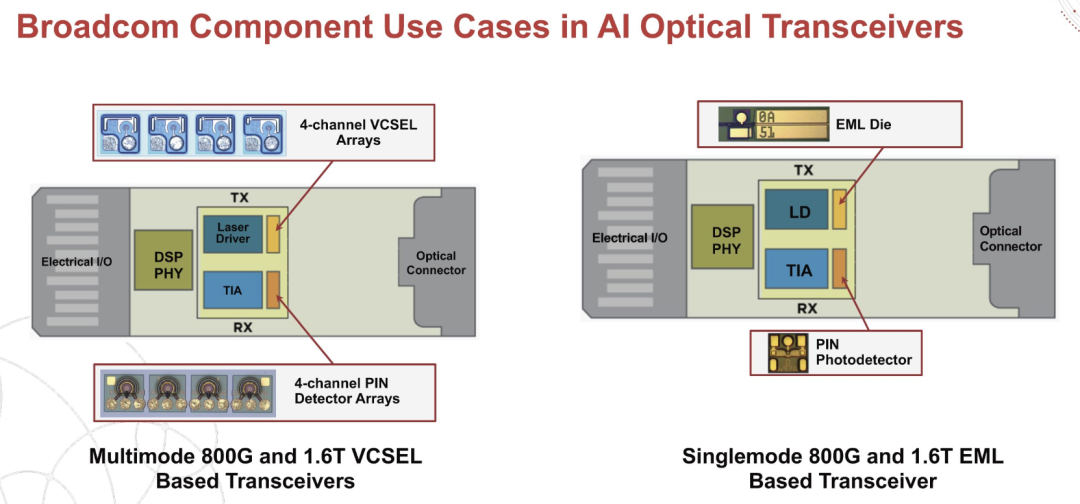

На конференции этого года мы увидели более широкий выбор оптических модулей с одноканальной скоростью 200 Гбит/с, а технологическая зрелость также значительно улучшилась по сравнению с предварительной демонстрацией в прошлом году. Например, компания Broadcom, принадлежащая Niu B, объявила о выпуске модуля EML 200 Гбит/с на канал и первого модуля VCSEL с вертикальным резонатором и пропускной способностью 200 Гбит/с на канал.

Но для модульного решения со скоростью одного канала 200 Гбит/с следует использовать LPO или LRO? Вы можете оставить сообщение, чтобы выразить свое мнение!

Каким бы ни было решение, я считаю, что одноканальные оптические модули со скоростью 200 Гбит/с могут сыграть более важную роль в таких ключевых областях, как соединение центров обработки данных, AI/ML и крупномасштабная сетевая передача.

Просто в чате, прошу простить если есть неточности, спасибо что дочитали! Добро пожаловать, следуйте за нами!

Неразрушающее увеличение изображений одним щелчком мыши, чтобы сделать их более четкими артефактами искусственного интеллекта, включая руководства по установке и использованию.

Копикодер: этот инструмент отлично работает с Cursor, Bolt и V0! Предоставьте более качественные подсказки для разработки интерфейса (создание навигационного веб-сайта с использованием искусственного интеллекта).

Новый бесплатный RooCline превосходит Cline v3.1? ! Быстрее, умнее и лучше вилка Cline! (Независимое программирование AI, порог 0)

Разработав более 10 проектов с помощью Cursor, я собрал 10 примеров и 60 подсказок.

Я потратил 72 часа на изучение курсорных агентов, и вот неоспоримые факты, которыми я должен поделиться!

Идеальная интеграция Cursor и DeepSeek API

DeepSeek V3 снижает затраты на обучение больших моделей

Артефакт, увеличивающий количество очков: на основе улучшения характеристик препятствия малым целям Yolov8 (SEAM, MultiSEAM).

DeepSeek V3 раскручивался уже три дня. Сегодня я попробовал самопровозглашенную модель «ChatGPT».

Open Devin — инженер-программист искусственного интеллекта с открытым исходным кодом, который меньше программирует и больше создает.

Эксклюзивное оригинальное улучшение YOLOv8: собственная разработка SPPF | SPPF сочетается с воспринимаемой большой сверткой ядра UniRepLK, а свертка с большим ядром + без расширения улучшает восприимчивое поле

Популярное и подробное объяснение DeepSeek-V3: от его появления до преимуществ и сравнения с GPT-4o.

9 основных словесных инструкций по доработке академических работ с помощью ChatGPT, эффективных и практичных, которые стоит собрать

Вызовите deepseek в vscode для реализации программирования с помощью искусственного интеллекта.

Познакомьтесь с принципами сверточных нейронных сетей (CNN) в одной статье (суперподробно)

50,3 тыс. звезд! Immich: автономное решение для резервного копирования фотографий и видео, которое экономит деньги и избавляет от беспокойства.

Cloud Native|Практика: установка Dashbaord для K8s, графика неплохая

Краткий обзор статьи — использование синтетических данных при обучении больших моделей и оптимизации производительности

MiniPerplx: новая поисковая система искусственного интеллекта с открытым исходным кодом, спонсируемая xAI и Vercel.

Конструкция сервиса Synology Drive сочетает проникновение в интрасеть и синхронизацию папок заметок Obsidian в облаке.

Центр конфигурации————Накос

Начинаем с нуля при разработке в облаке Copilot: начать разработку с минимальным использованием кода стало проще

[Серия Docker] Docker создает мультиплатформенные образы: практика архитектуры Arm64

Обновление новых возможностей coze | Я использовал coze для создания апплета помощника по исправлению домашних заданий по математике

Советы по развертыванию Nginx: практическое создание статических веб-сайтов на облачных серверах

Feiniu fnos использует Docker для развертывания личного блокнота Notepad

Сверточная нейронная сеть VGG реализует классификацию изображений Cifar10 — практический опыт Pytorch

Начало работы с EdgeonePages — новым недорогим решением для хостинга веб-сайтов

[Зона легкого облачного игрового сервера] Управление игровыми архивами