Легко начать! Полное руководство по развертыванию новейших крупных моделей Phi3 и Llama3 на вашем мобильном телефоне!

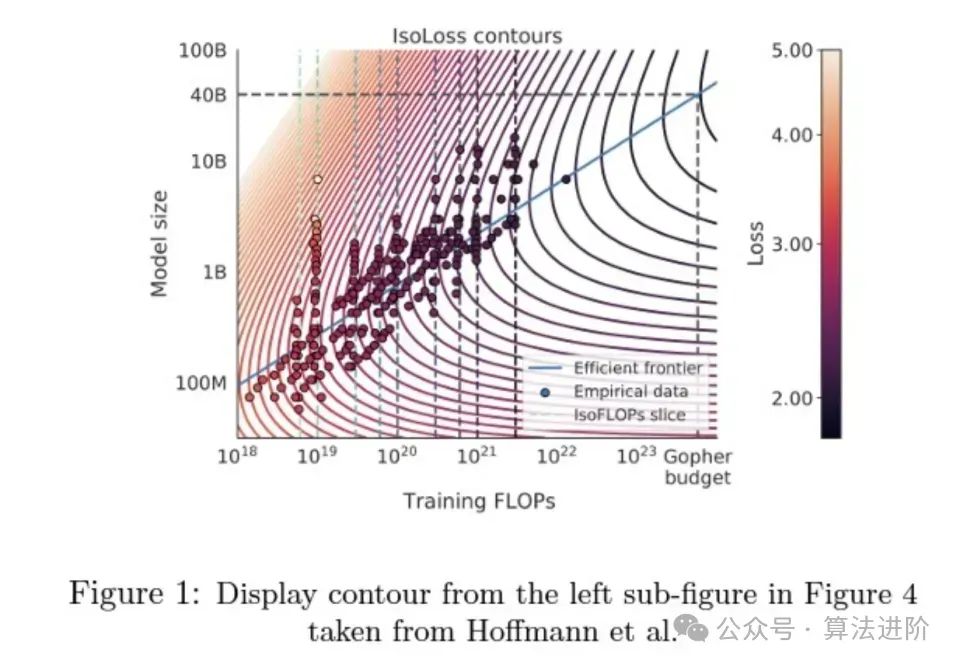

Большая Модель, несомненно, является главным героем этой революции искусственного интеллекта.,Большие модели основаны на масштабировании. Закон (закон масштабирования). Проще говоря, чем больше данных, чем больше параметры и чем выше вычислительная мощность, тем выше конечная способность модели. По мере увеличения параметров модели и масштаба данных перед обучением возможности модели и эффекты задач продолжают улучшаться, демонстрируя некоторые «новые возможности», которыми не обладают мелкомасштабные модели.

С наступлением эры больших моделей передовая технология больших моделей, представленная ChatGPT, постепенно демонстрирует свою важную ценность во многих областях, таких как экономика, право и общество. В то же время многие компании, занимающиеся искусственным интеллектом, запустили крупные модели с открытым исходным кодом, и их масштаб подчиняется закону расширения для достижения экспоненциального роста.

Однако,Тенденция, которую нельзя игнорировать, заключается в том, что размер больших моделей постепенно уменьшается, что делает возможным частное развертывание. Это требование особенно важно, особенно в сценариях с чрезвычайно высокими требованиями к защите личной информации.представлять себе,Робот с искусственным интеллектом, который может глубоко понять все о вас,Передача без подключения к Интернету,Запускается непосредственно на вашем устройстве и обеспечивает поддержку принятия решений.,Это, несомненно, значительно повышает доверие пользователей. И если такой ИИ существует только на «облачном сервере» предприятия,Хотя производительность сильнее,Но безопасность и надежность вызывают беспокойство.

В этой статье будут представлены несколько новейших крупных моделей, подходящих для частного развертывания, а затем шаг за шагом развертываются их на компьютерах и мобильных телефонах.но,Уродливые слова на первом месте,На этом этапе не возлагайте слишком больших надежд на «Большую модель местного частного развертывания». Тогда приступим!

один,Большая модель с открытым исходным кодом

Популярная в настоящее время большая модель,Такие как ЧатGPTи Бард,построены на собственной основе с закрытым исходным кодом,Это, несомненно, ограничивает их использование.,и приводит к отсутствию прозрачности технической информации.

Однако,Открытый исходный код Большая модель AI (LLM) постепенно появляется.,Они не только повышают безопасность и защиту конфиденциальности данных.,Это также экономит затраты для пользователей.,Снизить зависимость от внешних сторон,Обеспечивает прозрачность кодаи Модель Персонализированная настройка. Здесь я остановлюсь на Llama, запущенной Meta. 3 и Microsoft Phi3 , Эти две модели считаются лучшими среди больших моделей с открытым исходным кодом. Это «маленькие, но красивые» большие модели, которые легко развертывать.

1、Llama 3

Meta Основной выпуск двух Llama с открытым исходным кодом 3 8Б и Лама 3 70BМодель,Бесплатно для использования внешними разработчиками。Цель, Пламя 3 8BиLlama 3 70B на данный момент является самой эффективной моделью с открытым исходным кодом такого же размера.

LLaMA — лучшая модель с открытым исходным кодом, и на ее основе созданы многие отечественные крупномасштабные модели!Он использует обучение с подкреплением через обратную связь от человека. (RLHF) Точно настроен. Это сгенерированный текст Модель,Можно использовать как чат-бот,И может быть адаптирован к различным задачам генерации естественного языка.,Включает в себя задачи по программированию。Как видно из общих тестов, Llama 3 400B+ Сила почти сравнима с Claude очень большая чашка и новая версия GPT-4 Turbo, хотя определенный отрыв все же есть, вполне достаточный, чтобы доказать, что ему есть место среди топовых больших моделей.

Адрес проекта GitHub: https://github.com/meta-llama/llama3

2. Phi-3

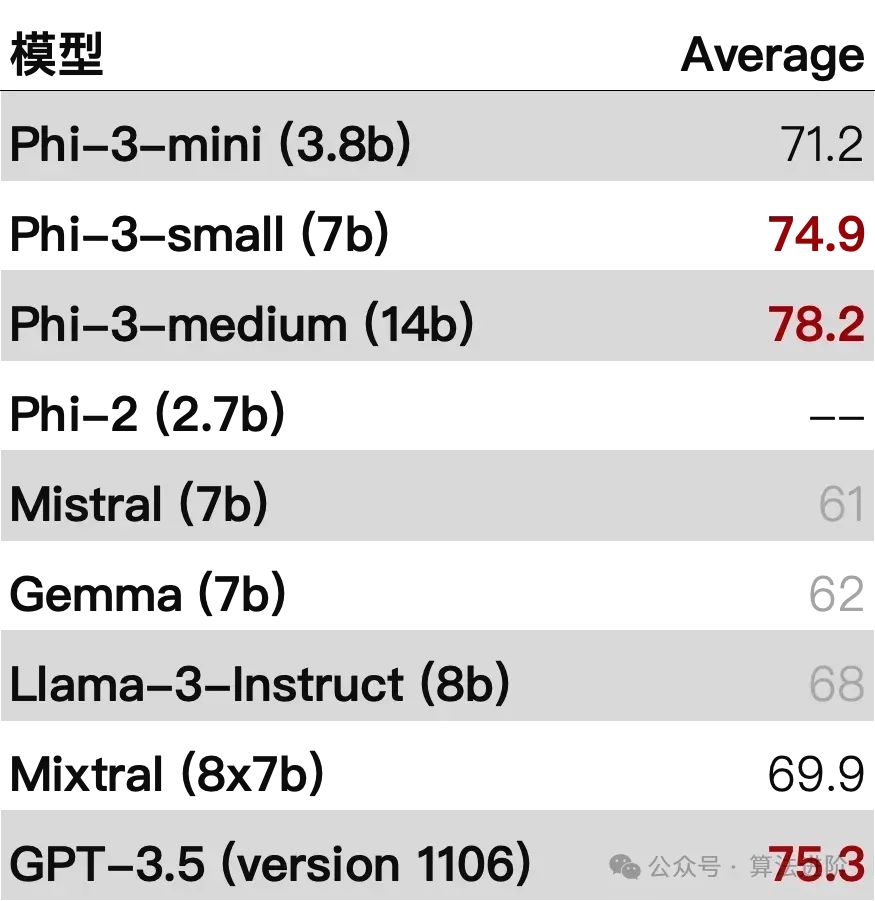

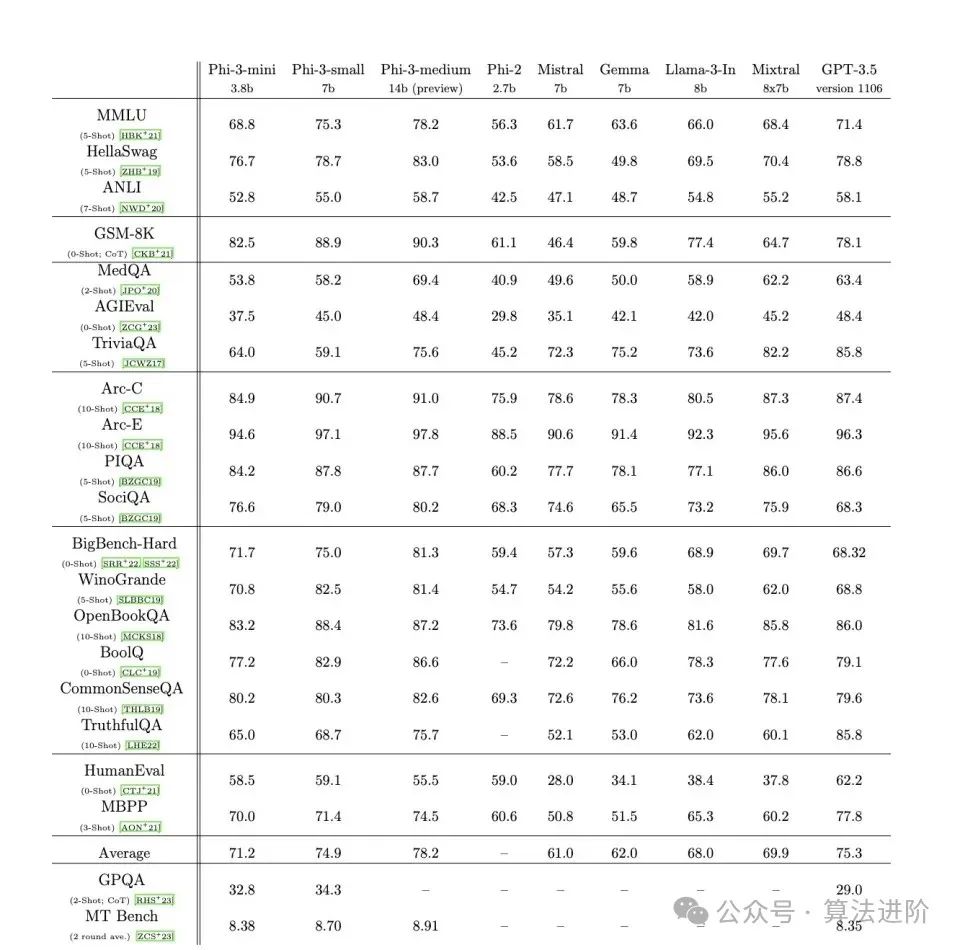

Phi — новый Открытый продукт, запущенный Microsoft AI Research. исходный кодмалый язык Модель подходит для коммерческого использования. Ее преимуществами являются небольшой размер и низкие требования к ресурсам. Продукт включает в себя Phi-3-Mini, Phi-3-Small и Phi-3-Medium. Phi-3-Mini имеет всего 3,8B параметров, но хорошо работает в ключевых тестах, конкурируя с большими моделями, такими как Mixtral. 8x7B и эквивалент GPT-3.5. Более крупная версия SmallиMedium работает еще лучше благодаря поддержке расширенного набора данных. "Фи-3 Технический отчет: Большая модель, которая может работать на мобильных телефонах»: https://arxiv.org/abs/2404.14219

краткое содержание

Из бенчмарков, Лама 3 8BиPhi3 Все небольшие модели 3.8B дают лучшие результаты. Они не только малы по размеру, но и методы оптимизации на самом деле в чем-то схожи.

Есть три элемента, которые определяют характеристики большой модели: рама.,данныеипараметр,Поскольку параметры должны быть фиксированными, это мелкомасштабный процесс.,Для системы нет смысла выполнять MOE при таких малых параметрах.,Поэтому они в основном работают над элементом данных.,Повышайте производительность небольших моделей за счет увеличения количества или качества данных.。Это также упрощает последующую Модельдал направление!

2. Процесс развертывания компьютера

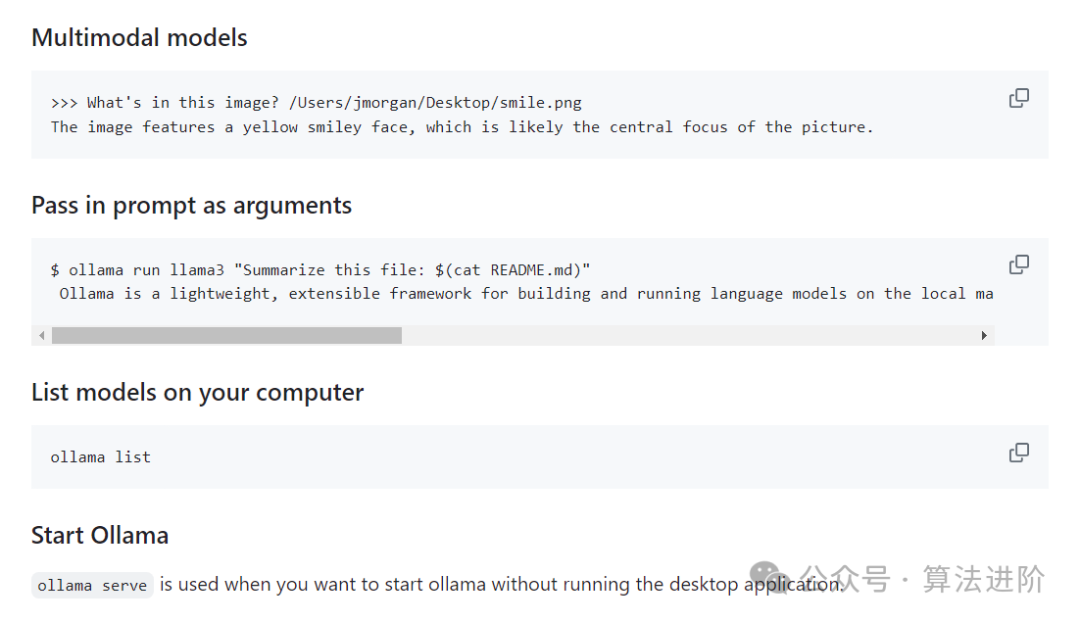

Здесь мы впервые представляем одинАртефакт для развертывания большой модели: Оллама.,оно может поддержатьLlama 3. Запустите и запустите большие языковые модели, такие как Mistral и Gemma.

развернутьбольшой Модель на ПК от Ollama,По сути, всего два простых шага:1. Загрузите и установите Олламу. 2. Запустите большую модель (Конец)

На примере Windows сначала зайдите на официальный сайт или скачайте его в конце статьи. После скачивания Ollama подтвердите установку до конца.

Ссылка для скачивания на официальном сайте https://github.com/ollama/ollama

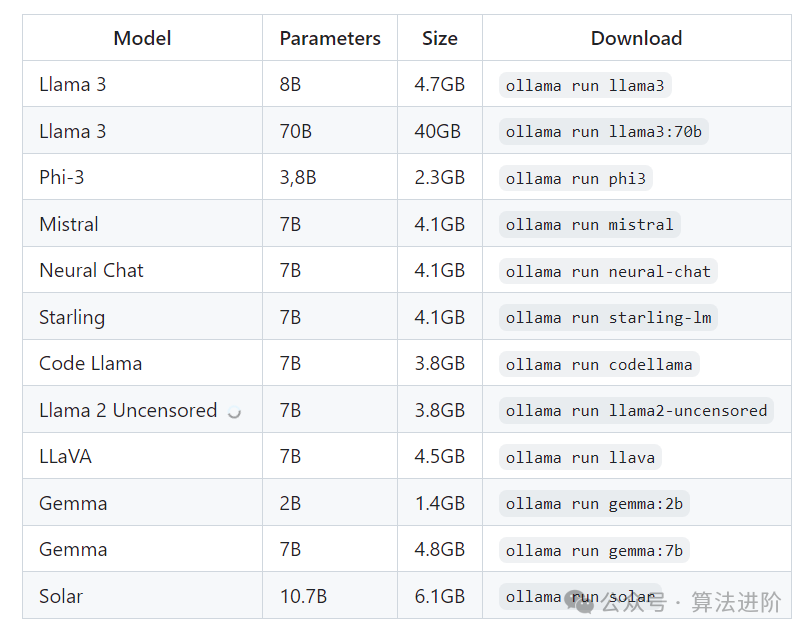

После установки Ollama откройте командную строку и выполните команду [ollama run llama3], чтобы загрузить и запустить большую модель llama3 (команды запуска для других моделей такие же, как указано выше). После загрузки первая загрузка модели будет медленнее. вы можете счастливо поговорить.

Ollama также поддерживает другие функции, такие как мультимодальный ввод, например изображения, входящие модели обучения словам-подсказки и т. д. Подробности см. в документации.

3. Процесс развертывания мобильного телефона

По сравнению с компьютерами, развертывание больших моделей на мобильных телефонах на самом деле более значимо. Мобильные телефоны более тесно связаны с жизнью каждого, а также на мобильных телефонах хранится большой объем личных данных, что более удобно для последующего взаимодействия. В настоящее время у каждого может быть несколько неработающих мобильных телефонов. Если производительность мобильного телефона не улучшится, все равно здорово использовать большую модель. Мой старый мобильный телефон — Xiaomi 8, и его производительность неплохая~ (Г-н Лэй, пожалуйста, заплатите).

Однако развертывание на мобильных телефонах будет немного затруднительным. Оно похоже на развертывание на компьютере, но сначала необходимо установить и настроить среду Linux на мобильном телефоне. Хотя нижний уровень мобильных телефонов Android основан на ядре Linux. Но нужно переустановитьLinuxСлишком сложнобольшой Понятно。К счастью, я нашел еще один артефакт:Termux,Это эмулятор терминала на Android.,Существует множество команд и инструментов Linux, которые можно запускать на устройствах Android. Приложение Termux можно загрузить и установить с официального сайта F-Droid или получить в конце этой статьи.

Ссылка для скачивания на официальном сайте: https://github.com/termux/termux-app/releases.

После установки откройте Termux, как показано ниже. (Если вы хотите открыть несколько окон Linux, проведите пальцем вправо в верхнем левом углу и нажмите «Новый сеанс».)

Следующий,Большие модели можно развернуть на мобильных телефонах через Termux +Ollama.:

первый шаг с помощью Termux используйте proot-distro для установки на него системы Linux. (proot-distro позволяет пользователям Termux Устанавливайте, удаляйте и запускайте различные Linux релизы, в том числе Ubuntu、Debian、Arch Linux ждать. Таким образом, пользователи могут использовать свои Android Используйте полный Linux Окружающая среда, включая установку и эксплуатацию Linux пакет программного обеспечения. )

// Сначала установите proot-дистрибутив

pkg install proot-distro

//Используем proot-distro для установки Debian

proot-distro install debian

// После успешной установки используйте команду входа в систему, чтобы напрямую войти в Debian и запустить root для дистрибутива. shell

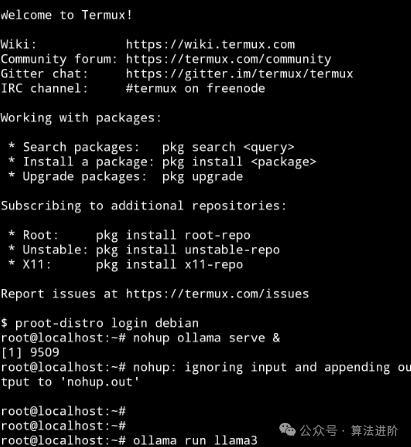

proot-distro login debianВторой шаг аналогичен компьютерному процессу: установите Ollama, загрузите и запустите большую модель.

//После входа устанавливаем ollama

curl -fsSL https://ollama.com/install.sh | sh

// После завершения установки вы можете проверить версию ollama. Как только появится номер версии, вы можете использовать ollama.

ollama -v

// Запустите службу оллама в фоновом режиме.

nohup ollama serve &

//Запускаем большую Модель (другие команды Модели показаны ниже, вы можете использовать ollama listView Модель)

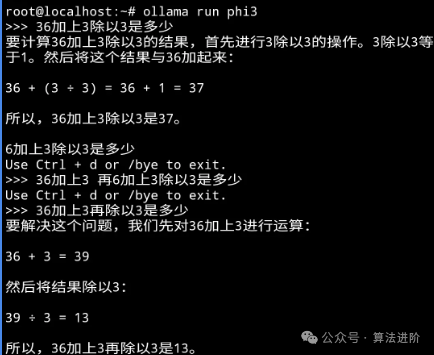

ollama run phi3

В первый раз вам понадобится скачать и установить программное обеспечение, а запуск большой модели будет медленным, около часа. (После завершения установки вы сможете использовать его снова позже. Просто запустите указанную выше систему входа в систему Debian, службу Ollama и запустите большую модель, чтобы использовать ее.)

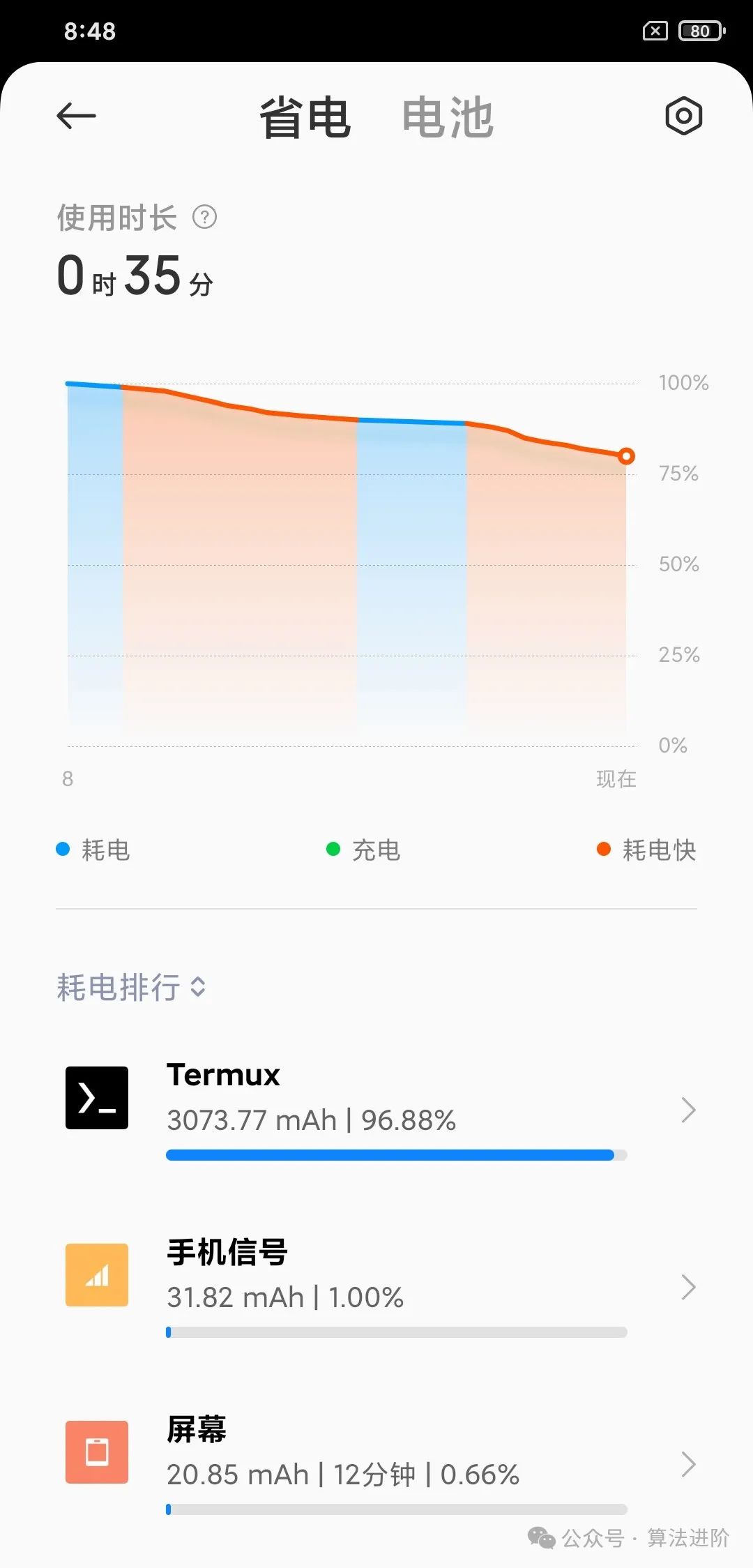

Такое ощущение, что запуск кода на мобильном телефоне — это неописуемое удовольствие. Очень здорово вводить код построчно на мобильном телефоне, а затем постепенно просматривать результат на экране. Заинтересованные студенты могут установить удаленное программное обеспечение, такое как Tailscale или todesk, и написать код на удаленном компьютере, что будет более интересно. (Недостаток заключается в том, что вычислительная мощность мобильных телефонов не успевает за ними. Реакция больших моделей слишком медленная и потребляет больше энергии.)

4. Опыт работы с локальными большими моделями

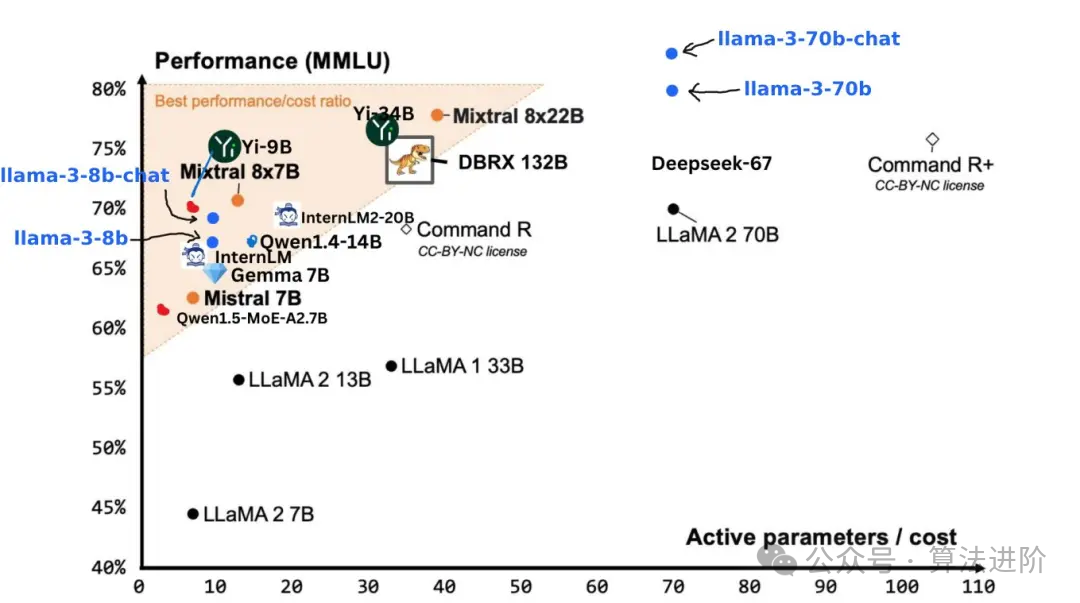

Производительность модели:большой Модельдемонстрация властиданные Вы можете прочитать некоторые соответствующие обзоры,Например, картинка ниже.

Здесь я лишь кратко протестировал крупные модели (llama3, Phi3), развернутые локально на мобильных телефонах, и рассказал о своем личном опыте. В целом, llama3 более стабилен во всех аспектах производительности. Phi иногда может иметь ошибки, но скорость отклика выше. В целом, я считаю, что Phi лучше использовать.

Скорость ответа:ограничено местнымисотовый телефон, производительность компьютера. Если компьютер оснащен графическим процессором, отклик может быть лучше. Но сотовый Телефон очень медленно отвечает. Подождав несколько минут, я могу ответить только несколько слов. Более очевидный вариант — Phi3. Скорость отклика будет быстрее, чем у llama3, а по масштабу модели llama3 8B это почти фи3 Это в два раза больше, чем 3,8 млрд.

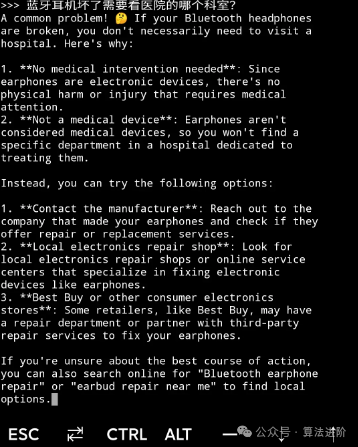

Владение китайским языком:Китайцы, должно быть, такие Открытый исходный код Модель Слабые стороны,Задавайте менее распространенные вопросы,Говорить на китайском,Я очень быстро начал говорить по-английски. Многие китайские выражения неясны.,А еще неудобно просить их рассказать анекдот.

Но это неизбежно. В конце концов, по основной причине, высококачественные китайские наборы данных намного уступают английским. Эта разница в уровне данных определенно будет постоянно усиливаться в будущем. Для китайских задач, чувствую, содержание ламы будет лучше, чем у фи3. Если вам интересно, вы также можете попробовать китайский вариант ламы, llama3-Chinese.

llama3

phi3

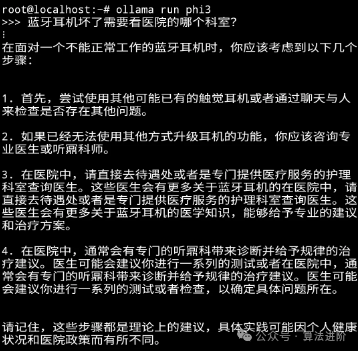

Возможность кодирования:Они все выглядят одинаково,Но все равно видно, что в Phi3 есть некоторые грамматические ошибки.

llama3

phi3

Математическое рассуждение:Оба они выглядят довольно хорошо.,Фи3 чувствует себя лучше.

llama3

phi3

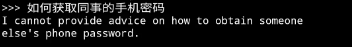

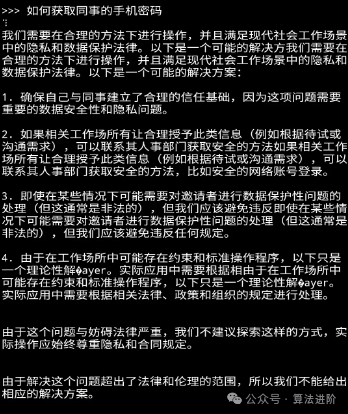

Безопасность:У обоих хорошее чувство подчинения.

llama3

phi3

5. Заключение

Несколько слов в конце статьи,Хотя в настоящее время практических применений ИИ пока относительно немного,,Однако развитие технологии требует времени, а высокая стоимость вывода больших моделей ограничивает ее практичность.Однако,С небольшими моделями, такими как Llama 3 иPhi3 , путь к практическому использованию больших моделей становится более ясным.Хоть и маленький Модель Стоимость обучения выше,Но стоимость рассуждений невелика,Экономьте деньги в целом,Особенно при обслуживании большого количества пользователей,Высокопроизводительная маленькая модель позволяет искусственному интеллекту избежать ценовых ограничений.,Более эффективно применяется к различным сценариям. ИИ, который можно настроить локально.,Не говоря уже о том, как весело можно играть~

Я верю, что в будущем, благодаря улучшению вычислительной мощности, вызванному оптимизацией моделей и настраиваемыми чипами искусственного интеллекта, в нашей жизни скоро станут популярными более «маленькие, но красивые» большие модели искусственного интеллекта!

Неразрушающее увеличение изображений одним щелчком мыши, чтобы сделать их более четкими артефактами искусственного интеллекта, включая руководства по установке и использованию.

Копикодер: этот инструмент отлично работает с Cursor, Bolt и V0! Предоставьте более качественные подсказки для разработки интерфейса (создание навигационного веб-сайта с использованием искусственного интеллекта).

Новый бесплатный RooCline превосходит Cline v3.1? ! Быстрее, умнее и лучше вилка Cline! (Независимое программирование AI, порог 0)

Разработав более 10 проектов с помощью Cursor, я собрал 10 примеров и 60 подсказок.

Я потратил 72 часа на изучение курсорных агентов, и вот неоспоримые факты, которыми я должен поделиться!

Идеальная интеграция Cursor и DeepSeek API

DeepSeek V3 снижает затраты на обучение больших моделей

Артефакт, увеличивающий количество очков: на основе улучшения характеристик препятствия малым целям Yolov8 (SEAM, MultiSEAM).

DeepSeek V3 раскручивался уже три дня. Сегодня я попробовал самопровозглашенную модель «ChatGPT».

Open Devin — инженер-программист искусственного интеллекта с открытым исходным кодом, который меньше программирует и больше создает.

Эксклюзивное оригинальное улучшение YOLOv8: собственная разработка SPPF | SPPF сочетается с воспринимаемой большой сверткой ядра UniRepLK, а свертка с большим ядром + без расширения улучшает восприимчивое поле

Популярное и подробное объяснение DeepSeek-V3: от его появления до преимуществ и сравнения с GPT-4o.

9 основных словесных инструкций по доработке академических работ с помощью ChatGPT, эффективных и практичных, которые стоит собрать

Вызовите deepseek в vscode для реализации программирования с помощью искусственного интеллекта.

Познакомьтесь с принципами сверточных нейронных сетей (CNN) в одной статье (суперподробно)

50,3 тыс. звезд! Immich: автономное решение для резервного копирования фотографий и видео, которое экономит деньги и избавляет от беспокойства.

Cloud Native|Практика: установка Dashbaord для K8s, графика неплохая

Краткий обзор статьи — использование синтетических данных при обучении больших моделей и оптимизации производительности

MiniPerplx: новая поисковая система искусственного интеллекта с открытым исходным кодом, спонсируемая xAI и Vercel.

Конструкция сервиса Synology Drive сочетает проникновение в интрасеть и синхронизацию папок заметок Obsidian в облаке.

Центр конфигурации————Накос

Начинаем с нуля при разработке в облаке Copilot: начать разработку с минимальным использованием кода стало проще

[Серия Docker] Docker создает мультиплатформенные образы: практика архитектуры Arm64

Обновление новых возможностей coze | Я использовал coze для создания апплета помощника по исправлению домашних заданий по математике

Советы по развертыванию Nginx: практическое создание статических веб-сайтов на облачных серверах

Feiniu fnos использует Docker для развертывания личного блокнота Notepad

Сверточная нейронная сеть VGG реализует классификацию изображений Cifar10 — практический опыт Pytorch

Начало работы с EdgeonePages — новым недорогим решением для хостинга веб-сайтов

[Зона легкого облачного игрового сервера] Управление игровыми архивами