ИИ автоматически редактирует и генерирует практику исследования видео

Нажмите «LiveVideoStack» выше, чтобы подписаться на нас.

▲Отсканируйте QR-код на картинке или нажмите, чтобы прочитать исходный текст▲ Узнайте больше о конференции по аудио и видео технологиям

//

Примечание редактора:С короткимвидео Пришествие времени,Использование коротких видеороликов в качестве носителя для продвижения музыки дает больше простора для воображения. Имея огромную библиотеку видео- и графических материалов, продюсерам музыкальных короткометражных фильмов часто приходится тратить много времени и энергии на поиск или создание изображений или видео, связанных с музыкальными короткометражными фильмами.,Это огромная трата человеческих и материальных ресурсов. LiveVideoStackCon NetEase Cloud Music была приглашена на конференцию Shanghai Station 2022 Эксперт по алгоритмам аудио и видео Чжао Цзянь подробно представил технические исследования и практику NetEase Cloud Music по реализации автоматического редактирования и генерации видео с помощью искусственного интеллекта, основанные на многолетнем накоплении возможностей мультимодальных алгоритмов в музыкальной сфере и реальных бизнес-потребностях.

Текст/Чжао Цзянь

Организация/LiveVideoStack

Привет всем, меня зовут Чжао Цзянь, я из NetEase Cloud Music. Темой этого обмена является исследование и практика автоматического редактирования AI для создания видео. Содержание в основном разделено на следующие части:

- What — Что такое музыка, автоматически генерируемая ИИ?

- Why — Зачем вам нужно автоматически генерировать музыку на основе ИИ?

- How — Как реализовать ИИ для автоматического создания музыки?

Во-первых, мы будем проигрывать три разных типа музыкальных клипов для всех. Во всем процессе нет участия человека, и он полностью автоматически генерируется искусственным интеллектом.

Эмоция, выраженная песней в первом видео, относительно соответствует сочетанию содержания видеоэкрана и общему визуальному колориту видео, что лучше передает эмоции создателя музыки. По сравнению с традиционными немузыкальными клипами, музыкальные клипы нуждаются в большем количестве изображений, чтобы передать эмоции музыки, а не просто объединять изображения.

Вы можете подумать, что второе видео — это просто музыкальное видео, созданное на основе простого сопоставления текста текста, но на самом деле оно создается путем объединения мелодии и комментариев к музыке.

Музыка третьего видео очень быстрая и сложная, поэтому соответствующее видео тоже страстное.

Характерной чертой музыкальных клипов является то, что музыка должна быть носителем эмоций, чтобы находить отклик у аудитории. Поэтому при создании видеороликов необходимо учитывать взаимосвязь эмоций и видео, а также соответствие, связность, цветопередачу и визуальность. соответствие ритма и картинки.

Все три вышеприведенных видеоролика созданы нашей аудио- и видеолабораторией с помощью системы музыкального видео «AI в один клик». Она объединяет атомарные алгоритмы, связанные с музыкой, видео, текстом и т. д., и анализирует их на основе двух частей музыкального контента. и видеоконтент. Полностью автоматически создавайте музыкальные клипы в модальных и многоракурсных форматах для облегчения создания, просмотра и распространения музыкальных клипов.

Деятельность NetEase Cloud Music Lab сосредоточена на разнообразии музыки, начиная с трех технических направлений: понимания, обработки и производства, чтобы обеспечить индивидуальную оптимизацию для различных бизнес-сценариев с целью улучшения восприятия потребителями. С этой целью мы разработали мощный пакет погружения в аудио и видео. Вы можете испытать захватывающий звук, запущенный в приложении. Что касается творчества, мы повышаем творческую эффективность авторов по двум направлениям: музыка и видео, включая автоматическое создание видео и музыки.

На основе базовых атомарных алгоритмов, накопленных и самостоятельно разработанных за многие годы, лаборатория предоставляет различные типы решений для различных направлений аудио- и видеобизнеса, обеспечивая безопасность различных типов продуктов NetEase Cloud Music на снимке.

1. Почему автоматическое создание клипов для музыкальных видеоклипов

Далее я официально познакомлю вас с исследованием и практикой автоматического редактирования и создания видео с помощью ИИ.

Прежде всего, почему музыкальные клипы генерируются автоматически? На картинке показана эволюция потребления музыки. Будь то первые кассеты, компакт-диски, MP3 или плейлисты от музыкальных стриминговых компаний, музыка всегда основывалась на невизуальном опыте прослушивания. В последние годы короткие видеоролики быстро развиваются. На видеосцене пользователям промывают мозги фоновой музыкой различных UGC-видео и собирают ту фоновую музыку, которая им интересна. Видео, как еще один эмоциональный носитель музыки, обеспечивает пользователям более захватывающее восприятие.

NetEase Cloud Music, ведущая компания по потоковой передаче цифровой музыки в Китае, также добилась некоторых успехов в области видеозаписи музыки.

Как показано на рисунке, левая сторона — это облачный музыкальный видеопродукт. Мы будем регулярно публиковать мероприятия по музыкальному видео в Юньцуне, чтобы поощрять к участию создателей музыкальных видео на платформе. Создатели выбирают видеоклипы, соответствующие музыке, из накопленной библиотеки видеоматериалов на основе разных типов музыки, а затем обрабатывают их с помощью инструментов видеомонтажа для окончательного создания музыкальных клипов. Общаясь с создателями платформы, мы обнаружили, что для большинства авторов болевой точкой является высокий порог создания музыкальных клипов. Им нужны не только определенные знания в области музыки, но и рабочая сила для управления относительно большой библиотекой видеоматериалов. Кроме того, им также необходимо научиться использовать профессиональные инструменты для редактирования видео.

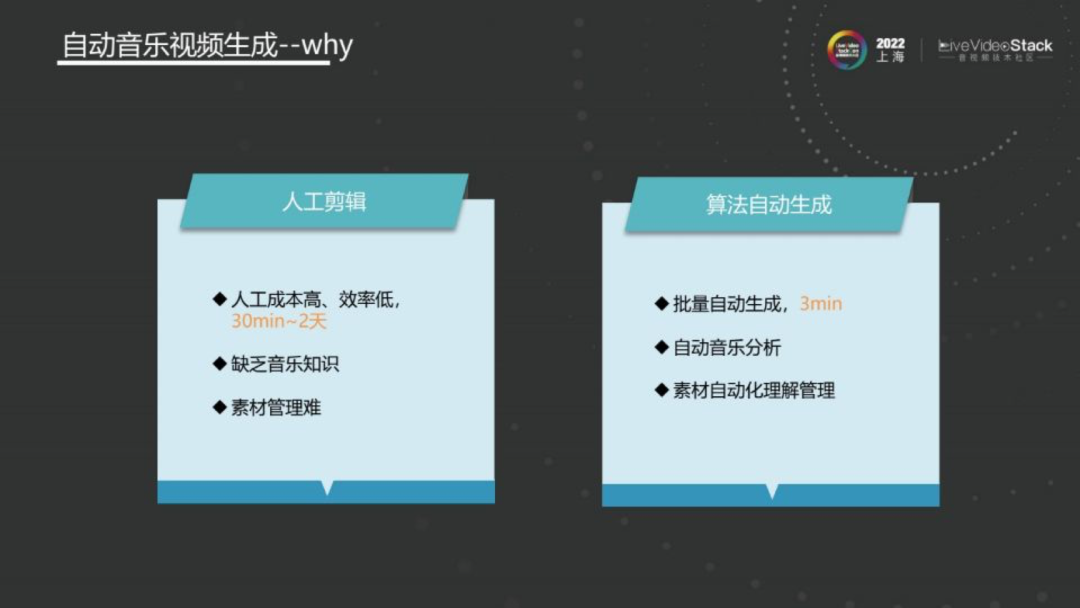

Как показано на рисунке, это результат нашего опроса создателей платформы. Сравнивая ручное редактирование и автоматическую генерацию алгоритмов, мы пришли к выводу, что создание высококачественного музыкального видео вручную обычно занимает от 30 минут до двух дней, при этом алгоритм полностью автоматизирован. и занимает в среднем от 30 минут до двух дней. Это занимает 3 минуты. (Статистика включает видео продолжительностью 15–30 секунд и видеоролики типа MV продолжительностью около 3–5 минут)

Многим авторам самим не хватает знаний в области теории музыки. Автоматическое создание алгоритмов может автоматически анализировать различные элементы музыки и автоматически управлять музыкой, видео и текстом с точки зрения материала. Сочетание этих двух факторов приносит пользу создателям, которые систематически не изучали аудио и музыку. редактирование видео. Хорошая новость: это также значительно повышает эффективность производства видео на платформе.

2. ИИ автоматически монтирует и создает музыкальную видеосистему.

Во-вторых, как создать систему, которая автоматически эффективно генерирует музыкальные клипы?

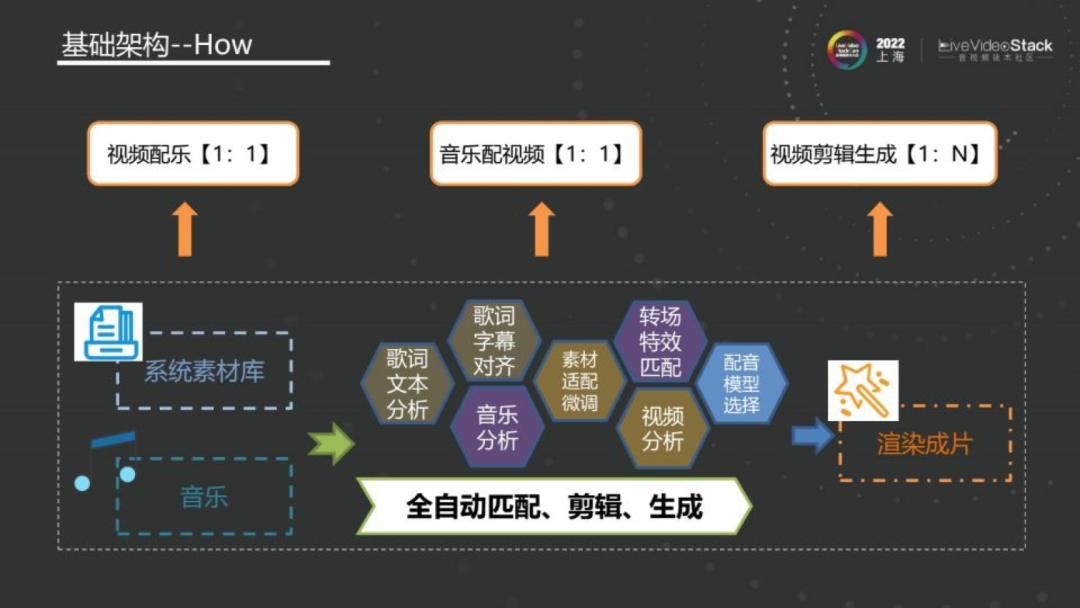

Как показано на рисунке, показана базовая схема архитектуры. Входной уровень находится в крайнем левом углу и в основном включает в себя музыку, которую пользователь хочет создать, и огромную библиотеку материалов. Уровень промежуточной обработки включает в себя полностью автоматизированные технологии, связанные с генерацией. наконец-то экранизирован.

Бизнес верхнего уровня поддерживает звуковую дорожку видео 1:1, включая музыку с видео. А возможности нашей системы позволяют генерировать музыкальные клипы в масштабе 1:N. Разница между 1:1 и 1:N заключается в том, что 1:1 снимает селфи-видео во время путешествия, а затем случайным образом выбирает подходящее музыкальное произведение из музыкальной библиотеки, так что музыкальное произведение связано только с одним видео. А 1:N — это выбрать несколько клипов из огромной видеотеки и обработать их для формирования полноценного видео на основе музыкального фрагмента.

Процесс автоматического создания музыкального видео примерно следующий: сначала загружаете произвольное музыкальное произведение и проводите его многомерный анализ с помощью музыкальных технологий, технологии НЛП, связанной с текстом, и многочисленных видеотехнологий. Технический акцент делается на анализе. данные каждой модальности.

Затем выполните мультимодальный поиск в библиотеке материалов и выберите множество возможных наборов на основе общего временного измерения музыки. Сверху вниз это можно понимать как временное развитие музыки, то есть в каждый момент времени есть много соответствующих видео, например первые 3 секунды. В списке кандидатов есть эти видео, но нам не нужно так много. видео, нам нужно только выбрать наиболее подходящие видео и убедиться, что окончательно выбранные видео могут сформировать оптимальную последовательность.

Наконец, есть более важные технологии аранжировки материалов и технологии, связанные с пост-аранжировкой, включая автоматическое сопоставление спецэффектов, автоматическое создание обложек видео и т. д.

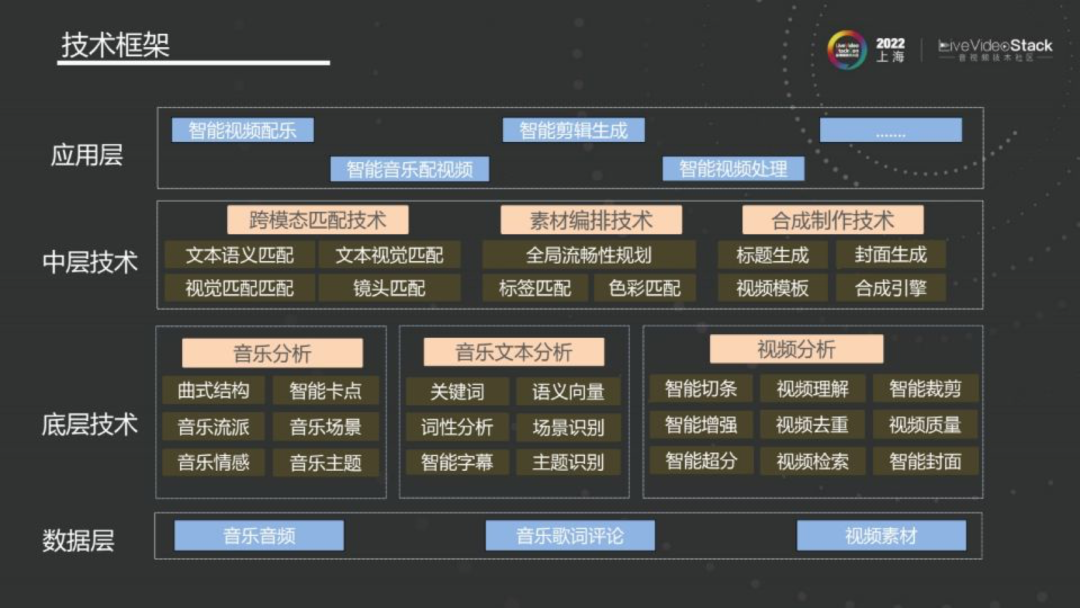

Как показано на рисунке, это полная техническая структура. Уровень данных служит входными данными для анализа алгоритмов верхнего уровня, включая аудио, связанные с музыкой, тексты песен, комментарии и материалы. Общий вид представляет собой мультимодальную информацию; базовая технология включает анализ музыки, анализ текста, анализ видео и т. д., работа заключается в понимании содержания различных модальностей, а также включает улучшение общего качества управляемых массивных материалов; технология среднего уровня включает кросс-модальность; Технология сопоставления, которая решает проблему сопоставления различных режимов музыкального аудио, музыкального текста и видео.

На уровне технологии размещения материалов он может гарантировать, что сгенерированная длинная последовательность видео соответствует визуальному цвету и гладкости человеческого глаза. Верхний слой — это соответствующие приложения, полученные на его основе.

2.1. Музыкальный анализ.

Далее будет подробно представлена техническая основа с четырех аспектов: во-первых, музыкальный анализ.

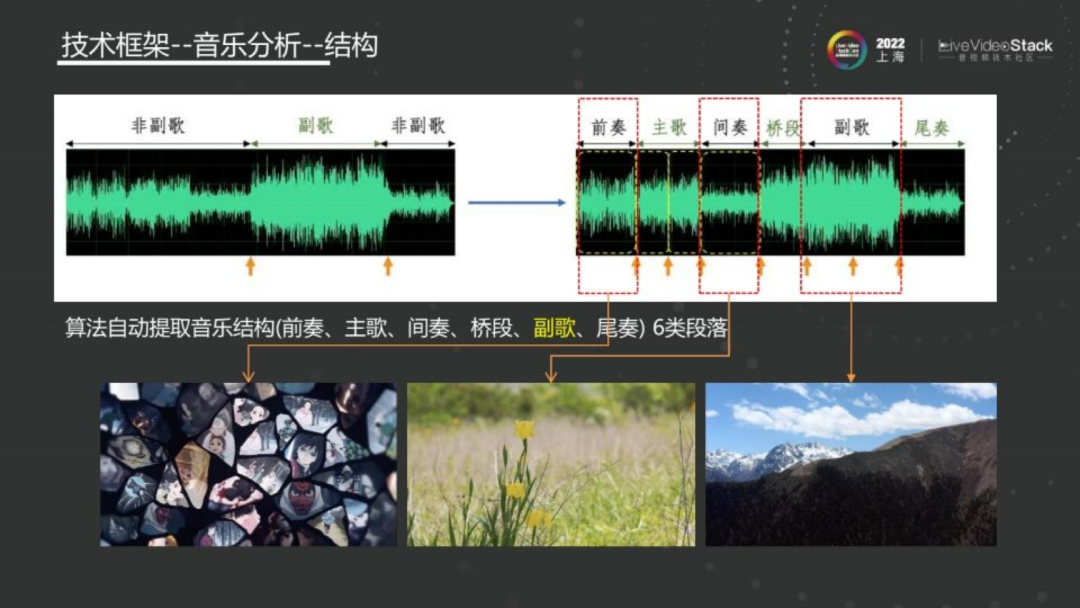

При написании произведения каждому наиболее знакома общая структура партитуры, которая соответствует структуре музыкальной формы в музыке, которую можно просто разделить на безприпев и припев. Более сложно, ее можно разделить на вступление, основную песню, интерлюдию, бридж и т. д. Вступление и основная песня аналогичны различным сегментам статьи. Если статью изменить на перевернутый формат, между ними можно сделать некоторые другие комбинации. абзацы, образующие различные музыкальные конструкции.

Поскольку мы генерируем видео под музыку, у нас должна быть возможность генерировать соответствующие видео для разных музыкальных сегментов, поэтому нам необходимо создать музыкальную структуру и автоматическое распознавание разных музыкальных сегментов. Наша цель — создать разные типы видеороликов, соответствующие разным абзацам, особенно для кульминации припева.

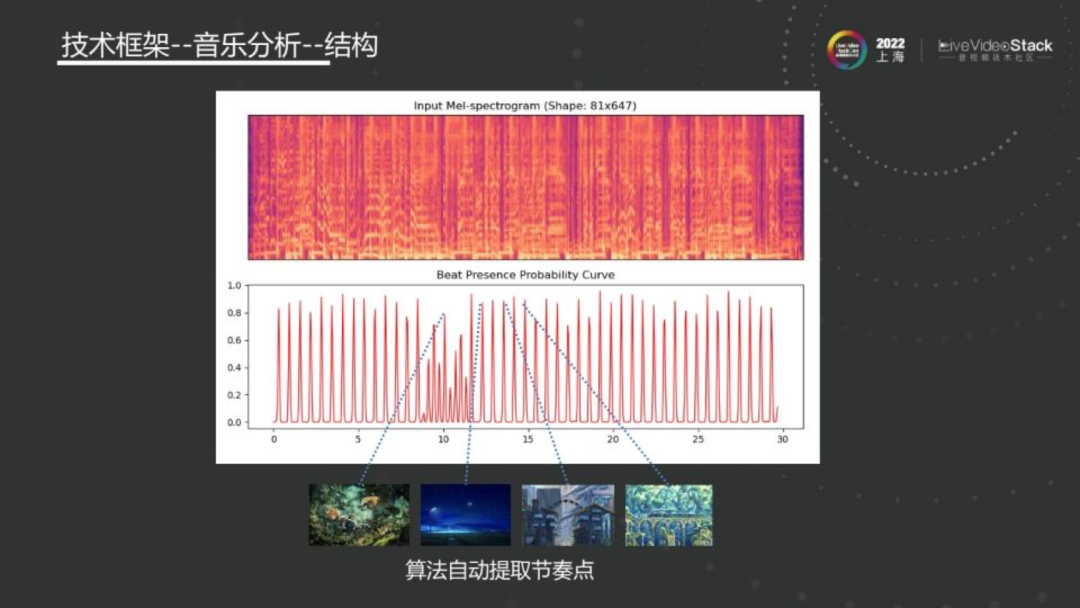

Абзацы в тяжелую музыкальную структуру были введены ранее, а затем были дополнительно подразделены точки ритма.

Точки ритма являются важным выражением музыкального ритма. Что касается алгоритма, мы реализовали методы представления точек ритма для разных типов песен и разных режимов, включая режим застрявших точек в мобильных приложениях для редактирования видео. Когда мы создаем музыку, точка застревания — это всего лишь небольшой модуль, охватывающий точки долей, небольшие узлы, точки абзацев и различные режимы. Мы наметили, какой тип карточек использовать при каких обстоятельствах, в зависимости от типа песни. Создатели и пользователи хотят, чтобы видеоэкран автоматически переключался в разных точках абзаца. На рисунке видно, что точка такта на пике эквивалентна точке такта звука, а видеоизображение переключается в каждой точке такта.

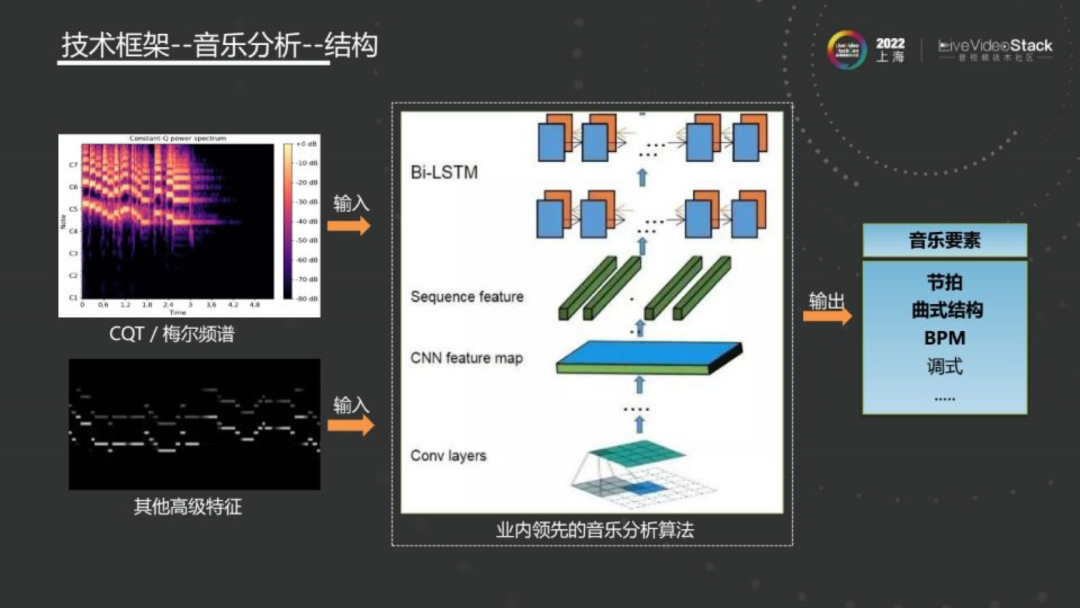

На рисунке отражен наш собственный ведущий в отрасли набор моделей анализа музыки с унифицированной многозадачной структурой, которая поддерживает алгоритмы и идентификацию музыкальных элементов, таких как музыкальная структура, точки удара, удары в минуту и т. д.

Существует множество проблем в создании единой структуры для многозадачности в музыкальном направлении. В отличие от аннотаций данных, таких как изображения, речь или указания НЛП, это проще и не имеет порога. Для музыки многозадачная аннотация требует сильного музыкального фона. Учитывая преимущества платформы, мы накопили большое количество многозадачных музыкальных данных. Структура многозадачной модели была унифицирована, а ее точность и производительность намного превосходят показатели одной модели.

Зачем создавать единую многозадачную структуру? Такие элементы музыки, как мелодия и аккорды, дополняют друг друга. Мелодию можно понимать как рисунок, нарисованный ребенком, а аккорды — как цветовую схему рисунка. Между ними существует неразрывная связь. Если их все объединить в одну задачу, информация о взаимных ограничениях будет потеряна, поэтому мы превратили ее в многозадачную структуру. Кроме того, если для каждого музыкального элемента выполняется отдельная задача, требуется N моделей, что приводит к очень низкой общей эффективности вычислений вывода.

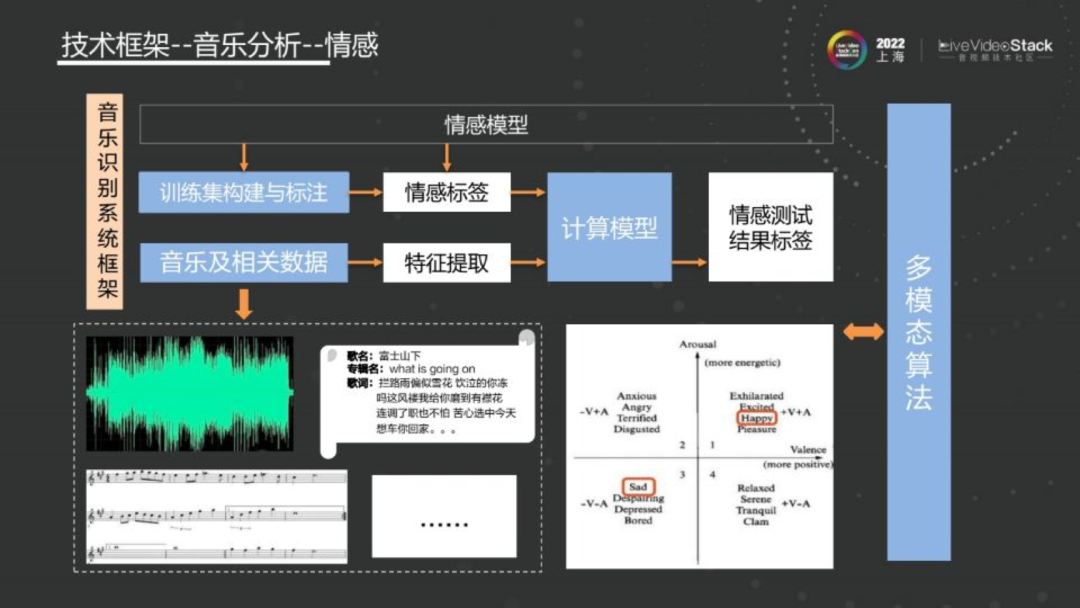

Музыкальные произведения сами по себе несут богатые эмоции, а также существует глубокая связь между эмоциями и визуальными цветами. Разные цвета могут отражать разные эмоции. Эмоция, соответствующая основной части песни на картинке, относится к нижнему уровню, и сочетать яркие цвета с малоэмоциональным участком явно неуместно. Поэтому необходимо автоматически определять эмоции музыки и сопоставлять ее с подходящими цветами.

Для автоматического распознавания музыкальных эмоций мы разработали мультимодальную сеть распознавания эмоций.

Система общего распознавания музыкальных эмоций верхнего уровня поддерживает замкнутый цикл от обучения до вывода, а нижний уровень поддерживает распознавание песен о любви в различных измерениях звука и текста. Поскольку эмоции сами по себе представляют собой сложный психологический процесс, который отражается не только в аудио и текстах песен, но и в комментариях, следующий раздел также включает аудио, тексты песен и информацию о комментариях. Общий алгоритм представляет собой мультимодальный алгоритм. Учитывая аудиофайл, включающий текстовую информацию, он может выводить автоматически распознаваемые эмоции.

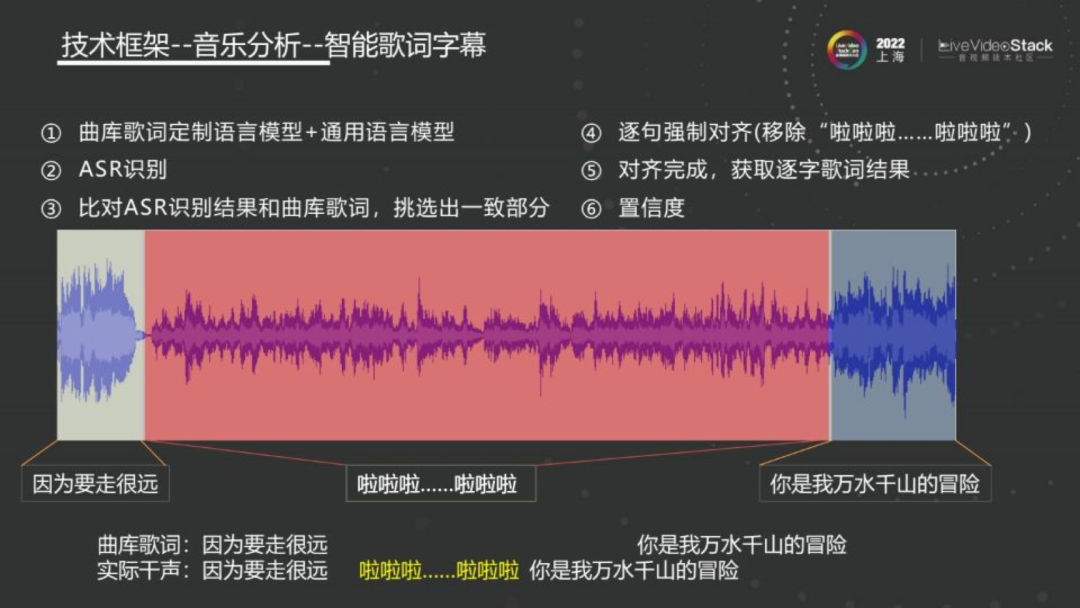

Музыкальные клипы чем-то похожи на традиционные КТВ и должны точно отображать тексты песен, соответствующие времени звука. Некоторые тексты песен на платформу загружаются пользователями UGC, которые любят музыку. Неизбежно будут присутствовать некоторые шумовые данные, то есть предоставленные тексты песен и время воспроизведения смещены или отсутствуют. На данный момент вам необходимо использовать алгоритм для внесения исправлений, то есть совместить временные метки аудио, предоставленные пользовательским контентом, с текстом песни. Мы используем распознавание речи и индивидуальные языковые модели для управления музыкой, а также используем эти два модуля для согласования текстов песен и временных меток звука.

Как показано на рисунке, в левой части отображается пословный текст текста, а временная метка каждого слова совпадает с временной меткой аудио. Справа расположены построчные тексты песен, при условии, что начальная временная метка построчных строк совпадает с временными метками аудио.

Есть много других аспектов музыкального анализа. Здесь мы в основном представляем методы, связанные с музыкальным текстом. Мы используем большие модели на стороне LP, связанные с глубоким обучением, такие как загрузочные и другие вычислительные модели, для выполнения задач, связанных с ключевыми словами, сущностями и семантическим сопоставлением на стороне музыкального текста. Целью создания информации о ключевых словах является удаление из текста песни информации, которая неэффективна для создания видео, чтобы извлечь ценную информацию. Кроме того, необходимо извлечь из текста песни специальные объекты. Наконец, существует семантическое сопоставление, которое в основном ориентировано на сходство на семантическом уровне текстовой стороны.

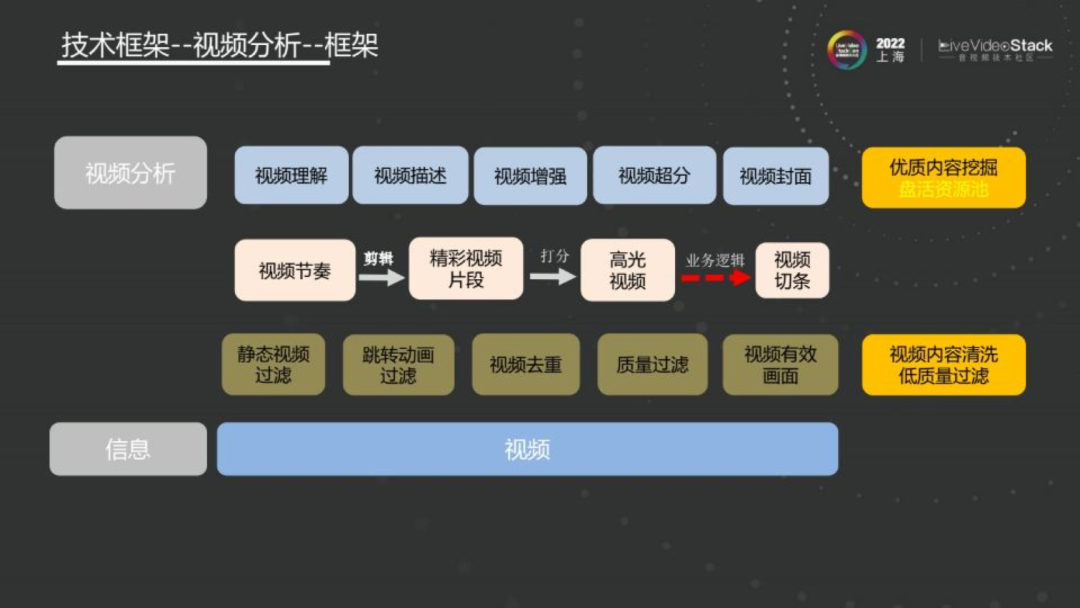

2.2. Видеоанализ

На рисунке показан процесс генерации видеоматериала. Во-первых, необходим источник данных. В качестве источника данных используется огромная база данных NetEase Group, предназначенная для создания и повторного использования источников материалов посредством загрузки пользователем и внешних покупок. Поскольку NetEase занимается не только музыкой, ей необходимо обрабатывать собранные источники материала в соответствии с музыкальными стандартами, включая серию ИИ-обработки, транскодирования, удаления и маркировки, связанной с видео. Кроме того, неизбежно будут появляться дубликаты видео, для чего необходимо удалять дубликаты, устранять дефекты, улучшать качество и т.д.

После выполнения вышеуказанных шагов 100% доступность еще не гарантирована, что требует введения стандартов ручной проверки на третьем этапе. Наконец, материалы, обработанные с помощью интеллектуальных алгоритмов и ручной проверки, будут распределяться между различными бизнес-подразделениями, образуя, таким образом, замкнутый цикл управления материалами.

Анализ видео в основном использует современные методы глубокого обучения, то есть алгоритмы обработки видео, связанные с искусственным интеллектом видео, наиболее важным из которых является удаление видео.

После того, как материал введен, сначала разбейте его на полоски, а затем разбирайте видео. Кроме того, поскольку само видео содержит недопустимые области, эффективные области необходимо обрезать. Для особых сценариев применения видео необходимо разделить и улучшить. Наконец, для сгенерированного видео грамотно подбирается обложка. Во всем процессе обработки используются не только популярные алгоритмы искусственного интеллекта, но и интегрированы традиционные, всеми игнорируемые алгоритмы видеоизображения.

Основная цель вышеуказанных шагов — фильтровать видеоконтент низкого качества и извлекать высококачественные материалы из огромной библиотеки.

Далее мы представим шесть пунктов, упомянутых выше: нарезку видео, эффективную область видео, повышение сверхвысокого разрешения видео, мультимодальность видео, расположение видео и обложку видео.

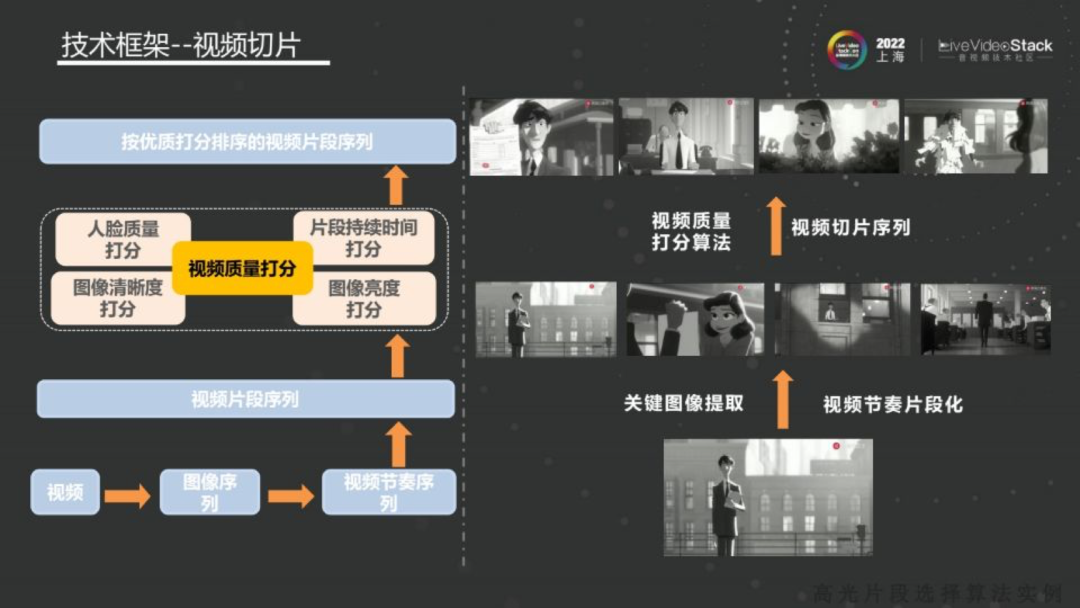

Многие видеоролики в исходном материале представляют собой длинные видеоролики и состоят из множества сцен и разных кадров. Для музыкальных клипов будет много избыточной видеоинформации. Цель нарезки видео — извлечь захватывающие видеоклипы и разрезать их по видеосценам для формирования серии видеопоследовательностей. Основная идея алгоритма состоит в том, чтобы извлечь ключевые кадры из кадров видеосцены, использовать алгоритмы, связанные с искусственным интеллектом (различные типы показателей качества, алгоритмы, связанные с продолжительностью сцены), и определить, является ли клип допустимым клипом ярких моментов на основе вес различных элементов, тем самым формируя серию видеоклипов.

Как показано на рисунке, слева — исходное видео, а справа — метод представления после нарезки видео в соответствии со сценой и объективом.

Мы предпочитаем получать более чистые материалы, но некоторые материалы получены в результате совместной работы пользователей и неизбежно включают в себя нечистые материалы. Например, субтитры включают текстовую информацию, несовместимую с видеоконтентом. Для этой цели мы используем традиционные методы позиционирования текста OCR глубокого обучения и преобразования Хафа для определения эффективной области видеоизображения. Для извлечения субтитров мы используем алгоритм для определения приблизительного местоположения (положение красной линии на изображении). Некоторые ученики могут быть в замешательстве: что делать, если в середине или других местах экрана появляется мешающий текст? Во-первых, необходимо удалить шумовые данные, использовать технологию распознавания речи, взвесить различные веса в зависимости от таких факторов, как продолжительность времени, в течение которого тексты песен должны появляться и центрированы ли они, определить, является ли текст, появляющийся на экране, субтитрами или помехами. информацию и, наконец, уничтожить ее. Зеленая часть на изображении справа — это последний оставшийся действительный видеоклип.

С момента разработки облачной музыки она больше не ограничивается одним приложением. Мы расширяем возможности одновременного использования нескольких терминалов, чтобы удовлетворить требования к специальному оборудованию. Например, когда материал 1920 отображается на экране 4K, требуется повышение сверхвысокого разрешения для удовлетворения потребностей отображения при различных разрешениях. В части улучшения представлено специальное улучшение портретной зоны фокусировки, которое не только улучшает общее видеоизображение, но также улучшает особые важные области, такие как обозначенные эффективные положения лица и пейзажи.

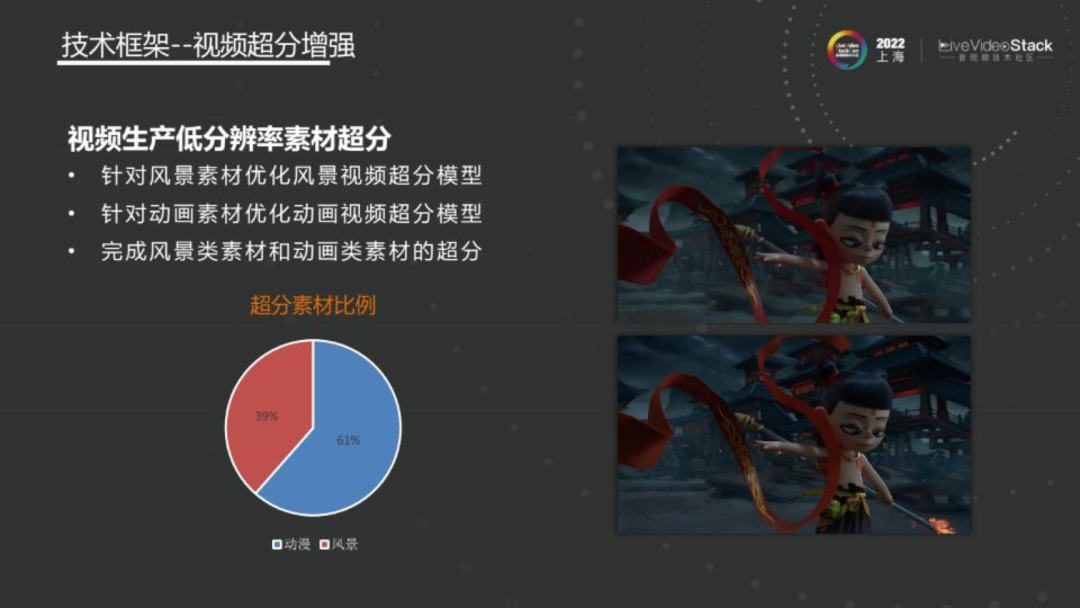

Что касается повышения сверхвысокого разрешения, мы в основном обрабатываем ландшафтное и анимационное сырье. В правом верхнем углу — исходное видео, а в правом нижнем — улучшенный визуальный эффект.

2.3. Расположение материалов

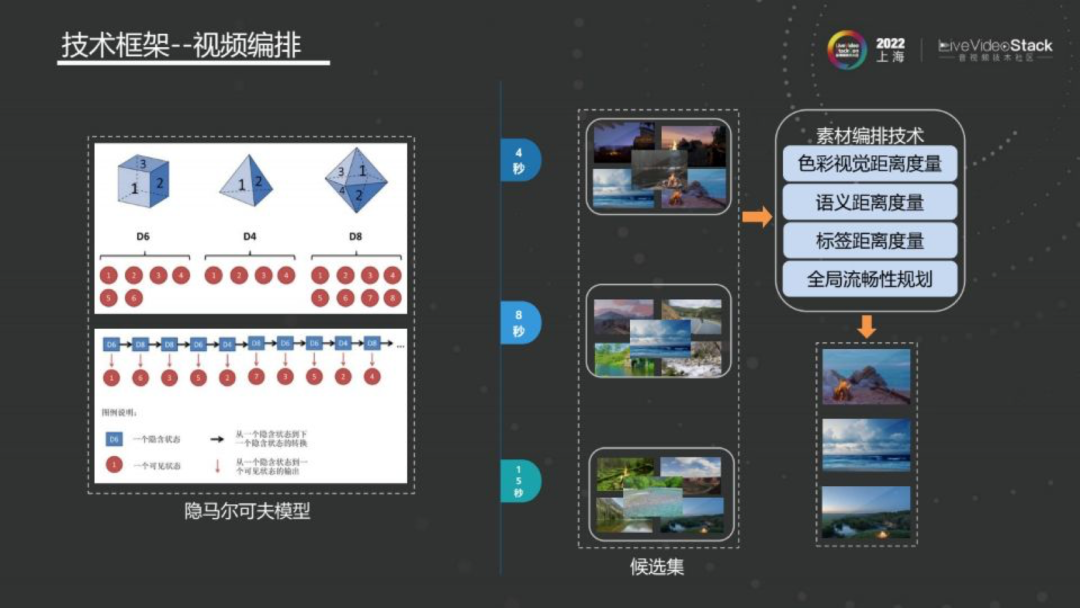

При создании музыкального видео в каждой позиции временной метки имеется N списков кандидатов на видео, что соответствует одному набору кандидатов для каждого периода времени. Тогда в каждый момент времени необходимо выбирать лишь небольшое количество видеороликов. При этом при выборе видеороликов на каждом этапе следует учитывать, что видеоролики, выбранные выше, и видеоролики, выбранные ниже, будут влиять друг на друга. вы должны учитывать как текущую временную метку, так и общую согласованность.

Исходя из этого, мы думаем, что в теории информации, чем меньше информационная энтропия, тем более упорядочена система. Для видеопоследовательностей идея аналогична. Классическим применением информационной энтропии является «Скрытая Маркова» в производственной модели. Мы учимся на «Скрытом Маркове» и рассматриваем текущее видео как заметное состояние. Однако конкретный порядок и взаимосвязь видео на самом деле являются скрытыми состояниями. Проблема, которую необходимо решить на данный момент, заключается в том, как гарантировать, какое видимое состояние выбрано в каждый период времени, а какое скрытое состояние. Наконец, цель достигается. помощью алгоритма глобальной оптимизации. В процессе оптимизации алгоритма мы учли метрическую информацию в различных измерениях, таких как зрение, семантика, метки и линзы. Из рисунка видно, что скомпилированный набор кандидатов сохраняет относительно оптимальные последовательности с точки зрения визуального и сценического аспектов.

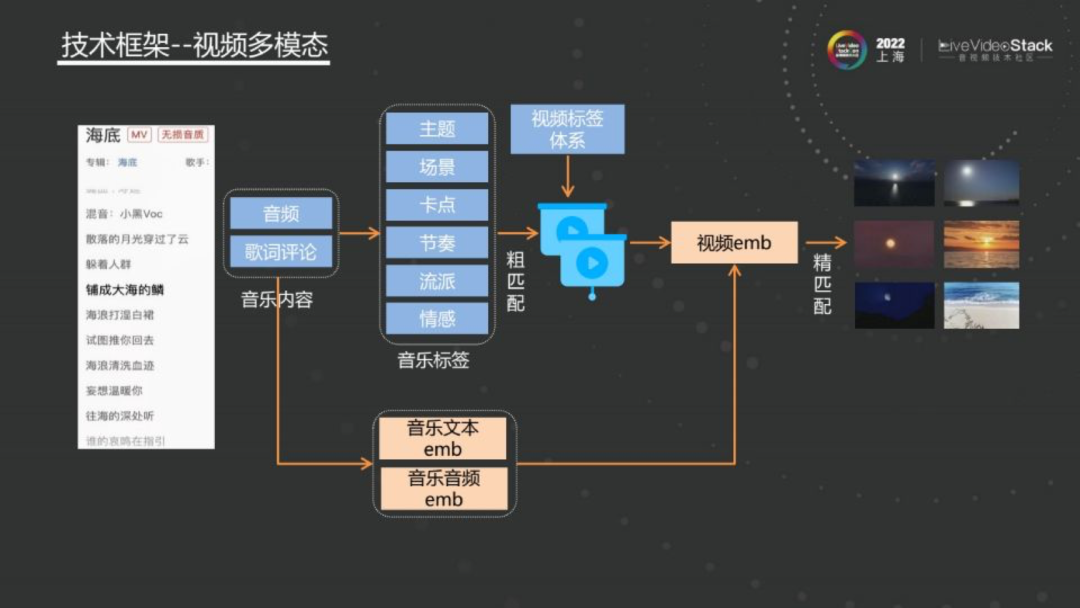

2.4. Мультимодальный анализ.

Мультимодальные аспекты в основном делятся на грубое и точное соответствие. На этапе грубого сопоставления мы используем теги каждой модальности, например соответствующие системы тегов для музыки и видео. Во время грубого сопоставления на основе сопоставления системы меток находится подходящий набор кандидатов чернового видео, а затем вводится слой внедрения различных режимов в каждом измерении, включая музыку, текст и музыкальный звук. Среди них встраивание музыки, текста, аудио и видео достигается путем обучения очень больших моделей, а многие высококачественные музыкальные клипы отбираются вручную.

Заимствованная здесь идея аналогична модели клипа, которая может автоматически сопоставлять текст с видео или изображениями или автоматически сопоставлять текст с видео. В основном она опирается на структуру большой модели для создания мультимодальной структуры обучения, которая в конечном итоге может быть использована. представляют аудио, текст и видео, и их можно получить разными способами. Эта технология имеет широкий спектр применений, включая сбор видео, сбор текстового аудио и кросс-модальный поиск. Эффект после точного сопоставления находится в крайнем правом углу.

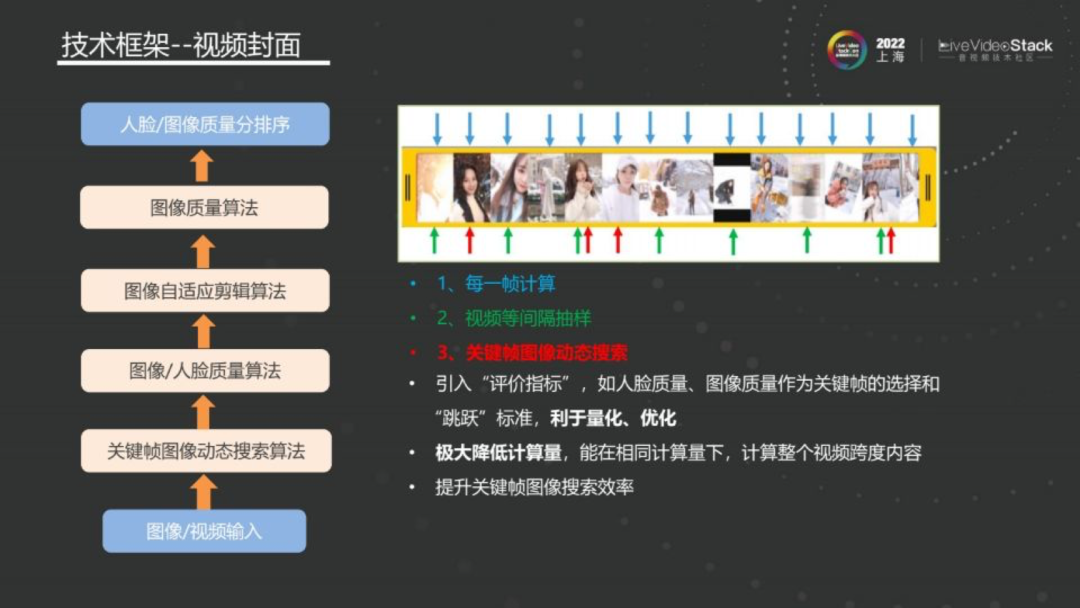

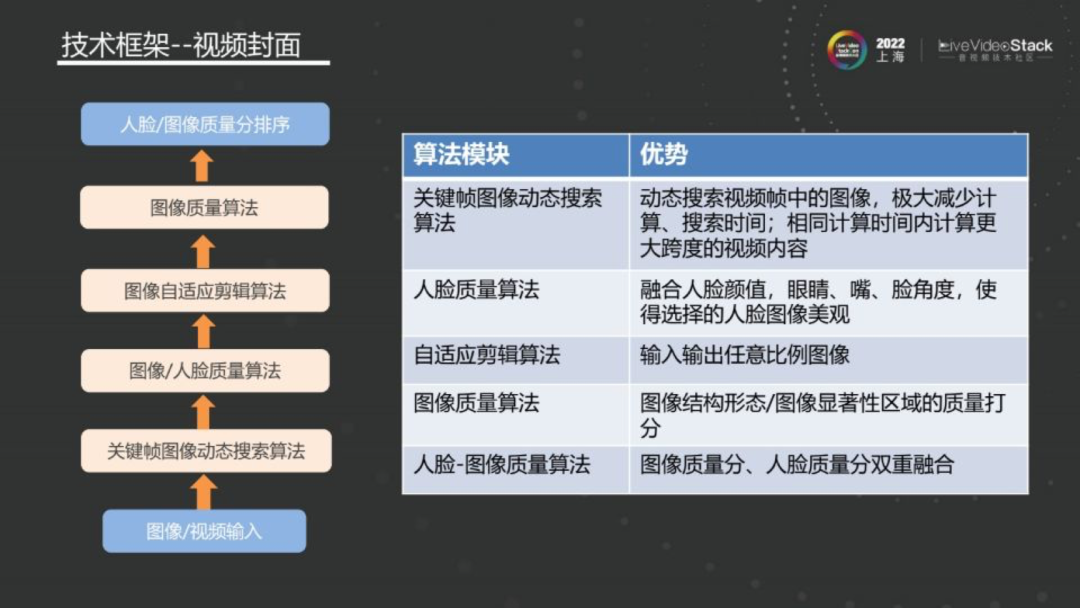

После создания видео обложка видео должна быть автоматически создана с помощью алгоритма. В основном он применяет технологию динамического поиска ключевых кадров видео, которая уменьшает объем вычислений и может рассчитывать содержимое всего видеопромежутка, обеспечивая эффективность вычислений и качество покрытия.

Затем он пройдет через ряд алгоритмов, связанных с качеством, включая алгоритм адаптивного редактирования изображений, который присваивает разные веса каждому параметру качества, и адаптивное редактирование для выбора наиболее подходящих обложек. По сравнению с технологией интеллектуальной крышки других конкурирующих продуктов, наша технология не полностью основана на алгоритмах искусственного интеллекта, но включает в себя множество традиционных алгоритмов управления.

На рисунке справа показаны преимущества, достигнутые благодаря использованию нашего интеллектуального алгоритма выбора обложек.

В крайнем левом углу находится исходное видео, а справа — сгенерированное изображение обложки разных размеров.

3. Исследование бизнес-сценария

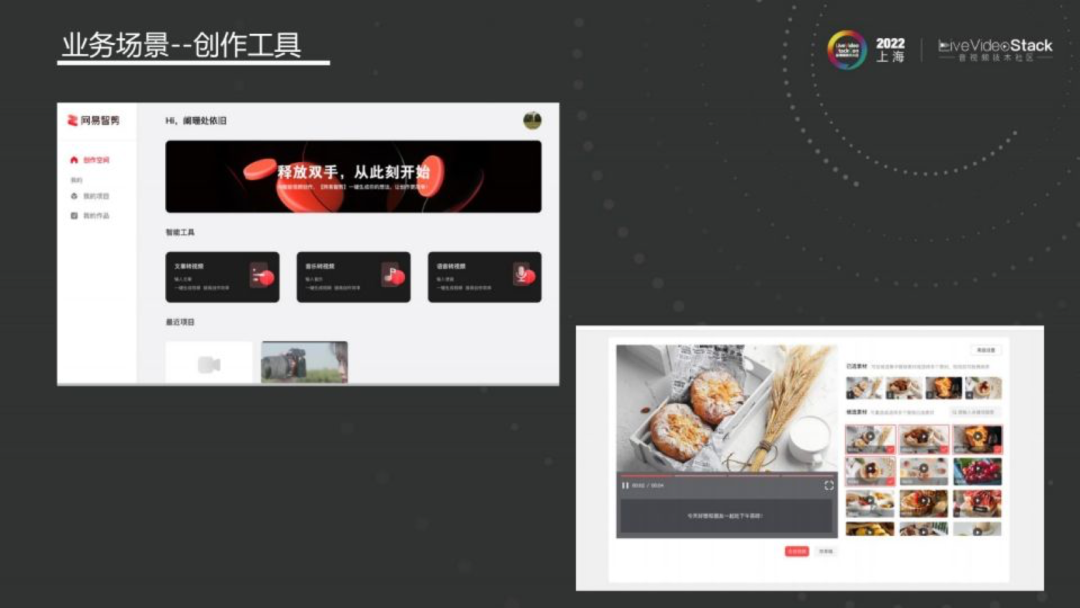

Как упоминалось выше, саундтрек к видео — это музыка в сочетании с видео. Мы реализовали эту технологию при прослушивании и просмотре, облачной деревне и создании видеороликов. Пользователи могут слушать музыку во время просмотра видео.

Что касается автоматического редактирования видео с помощью искусственного интеллекта, мы каждый день создаем множество видеороликов в пакетном режиме и работаем с создателями над созданием учетных записей видео в ходе их работы. В правом верхнем углу — анимация исцеления, в правом нижнем углу — чистое пейзажное видео, а в крайнем правом — чисто музыкальное видео.

Эта часть основана на технологии автоматических навыков искусственного интеллекта. Группа работала с другими бизнес-отделами над созданием платформы для создания видео с помощью искусственного интеллекта. Целью является улучшение контента, создаваемого PGC, включая UGC, и она также продолжает это делать. прилагать усилия в немузыкальных направлениях.

На рисунке показаны некоторые поддерживаемые нами преобразования голоса в видео или статьи в видео.

В то же время мы интегрировали этот набор технологий в NetEase Central и Тайвань, чтобы сформировать связь между технологиями и технологиями, а также интегрировали возможности в разделах просмотра контента и производства распространения в NetEase Central и Тайване.

4. Резюме и перспективы

Теперь, когда система автоматической генерации музыкальных видео создана, необходимо подумать о том, как оценить качество сгенерированных видео и коэффициент конверсии самой песни на более позднем этапе, поэтому необходимо создать систему оценки музыкальных видео. .

Кроме того, необходимо расширить возможности автоматического редактирования, чтобы расширить возможности людей в немузыкальных направлениях. Наконец, мы продолжим улучшать библиотеку материалов, включая расширение типов тем, и продвигать ее использование более целевыми авторами.

Выше представлен весь контент, которым поделились на этот раз, спасибо!

(Полный текст заканчивается)

▼Узнайте QR-код или нажмите на изображение ниже, чтобы подписаться на курс▼

Если вам нравится наш контент, нажмите «Смотреть»!

Неразрушающее увеличение изображений одним щелчком мыши, чтобы сделать их более четкими артефактами искусственного интеллекта, включая руководства по установке и использованию.

Копикодер: этот инструмент отлично работает с Cursor, Bolt и V0! Предоставьте более качественные подсказки для разработки интерфейса (создание навигационного веб-сайта с использованием искусственного интеллекта).

Новый бесплатный RooCline превосходит Cline v3.1? ! Быстрее, умнее и лучше вилка Cline! (Независимое программирование AI, порог 0)

Разработав более 10 проектов с помощью Cursor, я собрал 10 примеров и 60 подсказок.

Я потратил 72 часа на изучение курсорных агентов, и вот неоспоримые факты, которыми я должен поделиться!

Идеальная интеграция Cursor и DeepSeek API

DeepSeek V3 снижает затраты на обучение больших моделей

Артефакт, увеличивающий количество очков: на основе улучшения характеристик препятствия малым целям Yolov8 (SEAM, MultiSEAM).

DeepSeek V3 раскручивался уже три дня. Сегодня я попробовал самопровозглашенную модель «ChatGPT».

Open Devin — инженер-программист искусственного интеллекта с открытым исходным кодом, который меньше программирует и больше создает.

Эксклюзивное оригинальное улучшение YOLOv8: собственная разработка SPPF | SPPF сочетается с воспринимаемой большой сверткой ядра UniRepLK, а свертка с большим ядром + без расширения улучшает восприимчивое поле

Популярное и подробное объяснение DeepSeek-V3: от его появления до преимуществ и сравнения с GPT-4o.

9 основных словесных инструкций по доработке академических работ с помощью ChatGPT, эффективных и практичных, которые стоит собрать

Вызовите deepseek в vscode для реализации программирования с помощью искусственного интеллекта.

Познакомьтесь с принципами сверточных нейронных сетей (CNN) в одной статье (суперподробно)

50,3 тыс. звезд! Immich: автономное решение для резервного копирования фотографий и видео, которое экономит деньги и избавляет от беспокойства.

Cloud Native|Практика: установка Dashbaord для K8s, графика неплохая

Краткий обзор статьи — использование синтетических данных при обучении больших моделей и оптимизации производительности

MiniPerplx: новая поисковая система искусственного интеллекта с открытым исходным кодом, спонсируемая xAI и Vercel.

Конструкция сервиса Synology Drive сочетает проникновение в интрасеть и синхронизацию папок заметок Obsidian в облаке.

Центр конфигурации————Накос

Начинаем с нуля при разработке в облаке Copilot: начать разработку с минимальным использованием кода стало проще

[Серия Docker] Docker создает мультиплатформенные образы: практика архитектуры Arm64

Обновление новых возможностей coze | Я использовал coze для создания апплета помощника по исправлению домашних заданий по математике

Советы по развертыванию Nginx: практическое создание статических веб-сайтов на облачных серверах

Feiniu fnos использует Docker для развертывания личного блокнота Notepad

Сверточная нейронная сеть VGG реализует классификацию изображений Cifar10 — практический опыт Pytorch

Начало работы с EdgeonePages — новым недорогим решением для хостинга веб-сайтов

[Зона легкого облачного игрового сервера] Управление игровыми архивами